OpenBook

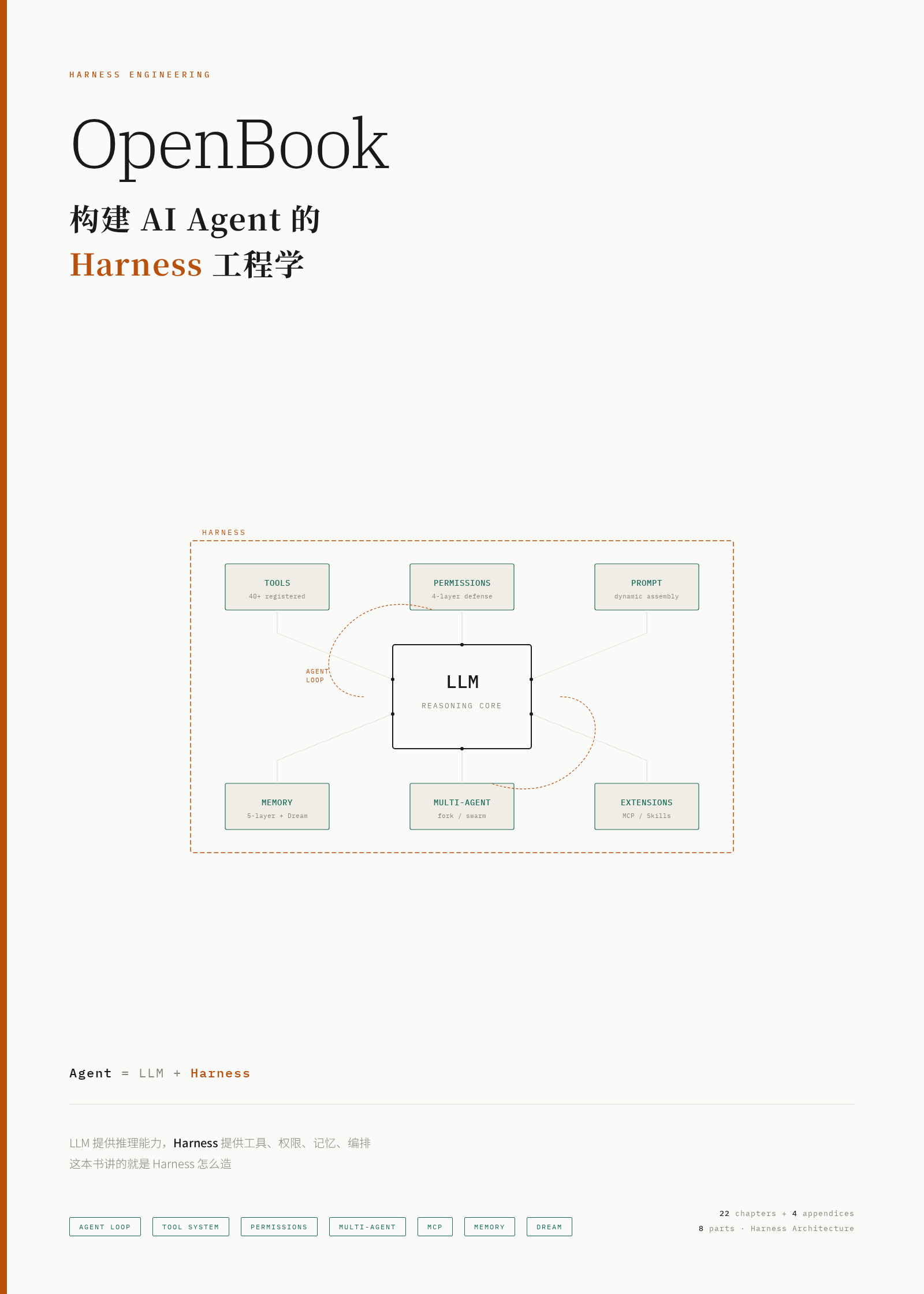

构建 AI Agent 的 Harness 工程学

Agent = LLM + Harness — 这本书讲的是 Harness 怎么造

English · 在线阅读 · 中文 PDF · English PDF · 参考文献

26 章 · 9 Part · 4 附录 · 中英双语

This is an independent educational analysis of AI agent architecture patterns. All code examples are pseudocode. No proprietary source code is reproduced.

关于本书

为什么写这本书

2025 到 2026 年,AI Agent 经历了从概念到产品的爆发。OpenAI 的 Sam Altman 宣称「Agent 将成为 AI 的杀手级应用」;Anthropic CEO Dario Amodei 在《Machines of Loving Grace》中描绘了 Agent 深度参与软件工程的未来;Andrew Ng 在多次演讲中强调「Agentic Workflow 是释放 LLM 真正潜力的关键」——不是让模型一次性给出答案,而是让它像人类一样迭代:思考、行动、观察、调整。到了 2026 年,各种 Agent 产品(Cursor、Windsurf、Devin 等)已成为开发者的日常工具。Agent 的时代不是即将到来——它已经到来了。

但当我们打开一个真正的 Agent 产品的源码时,会发现一个令人惊讶的事实:LLM 本身只占代码量的极小部分。绝大多数代码在做另一件事——构建围绕 LLM 的运行时框架。

Andrej Karpathy 曾将 LLM 类比为「新的操作系统内核」。如果 LLM 是内核,那么工具系统是系统调用,权限模型是访问控制,上下文管理是内存管理,多 Agent 编排是进程调度。这整套包裹在 LLM 外层的基础设施,就是 Harness。

什么是 Agent Harness

"A model that can call tools and take actions is nice. A model wrapped in a harness that manages permissions, handles errors, preserves context, and coordinates with other agents -- that's a product."

业界对这一层有不同的称呼:Anthropic 的 "Building Effective Agents" 指南称之为 orchestration framework(编排框架);LangChain 的 Harrison Chase 称之为 agent runtime(智能体运行时);AWS Bedrock 的文档称之为 agent orchestration layer(智能体编排层)。本书统一使用 Harness(运行时框架)这个术语——它最准确地传达了「套在 LLM 外面的缰绳与工具」的含义。

核心主张:Agent = LLM + Harness。

+--------------------------------------------------+

| A G E N T |

| |

| +----------+ +-------------------------+ |

| | | | H A R N E S S | |

| | LLM | | | |

| | |<---->| 工具 | 权限 | 记忆 | |

| | (推理) | | 编排 | 扩展 | 上下文 | |

| | | | | |

| +----------+ +-------------------------+ |

| |

| ~1% 代码量 ~99% 代码量 |

+--------------------------------------------------+

LLM 提供推理能力,Harness 提供工具、权限、记忆、编排。这本书讲的就是 Harness 怎么造。

本书的切入点

2026 年的今天,Agent 框架遍地开花——LangChain、CrewAI、AutoGen、OpenAI Agents SDK、AWS Bedrock Agents......但绝大多数框架做的是编排层的抽象,告诉你怎么把工具串起来,却不告诉你框架本身是怎么造的。

本书不同。我们从生产级 Agent 系统的工程实践中,提炼出构建 Harness 的通用设计模式。这些模式覆盖了 Agent 工程的每一个关键维度:

| Agent 核心能力 | Harness 的设计模式 | 本书章节 |

|---|---|---|

| 规划与编排 | 协调者模式、多阶段编排、Plan Mode | Part V, Ch 13 |

| 记忆与状态 | 多层配置文件、类型化自动记忆、后台整合 | Part VI, Ch 17 |

| 工具使用 | 工具注册表、调度器、延迟 Schema 加载 | Part III, Ch 6-8 |

| 行动与执行 | Agent Loop、流式执行、错误恢复 | Part II, Ch 3-5 |

| 安全与约束 | 多层权限防线、ML 分类器、可编程 Hook | Part IV, Ch 9-11 |

| 多智能体协作 | 状态 fork/隔离/通信、Swarm、Mailbox 模式 | Part V, Ch 12-15 |

| 生态扩展 | MCP 协议、Skills 系统、Plugin 体系 | Part VII, Ch 18-20 |

| 云上部署 | 四支柱框架、双 Pod 沙箱、自修复循环 | Part IX, Ch 23-26 |

市面上讲 Agent 的书不少,但多数停留在 Prompt Engineering 和 API 调用的层面。本书要做的是打开黑箱——不是教你怎么用 Agent 框架,而是让你看清框架本身的骨架、肌理和设计取舍。这些模式不绑定特定产品,可以迁移到任何 Agent 系统的构建中。

本书的方法论

Anthropic 的 "Building Effective Agents" 指南开篇就说:"The most successful implementations we've seen aren't using complex frameworks -- they're using simple, composable patterns."

本书遵循同样的理念。我们不是在罗列代码,而是在回答三个问题:

- 这部分要解决什么问题? —— 每一节从真实的工程困境出发

- 设计者是怎么想的? —— 为什么选这个方案而不是其他方案

- 代码是怎么做的? —— 源码只是验证思路的证据,不是阅读的主体

OpenAI 的 Swarm 框架文档说:"The best way to understand agents is to build one." 本书在 Appendix D 提供了一个从零构建 Mini Agent Harness 的实战教程——读完理论后动手验证。

谁应该读这本书

- AI 应用开发者——想构建自己的 Agent 产品,需要理解生产级 Harness 的设计模式

- 架构师——评估 Agent 框架时需要理解底层原理,而不只是看 API 文档

- LLM 研究者——想理解模型能力如何通过工程手段被放大(或约束)

- 对 AI Agent 好奇的技术人员——想超越 Demo 和 Prompt Engineering,看看真正的 Agent 是怎么运转的

你不需要读过该系统的源码才能理解本书。每章都从问题出发,用类比和叙事引导理解,源码引用作为佐证。但如果你对该 Agent 系统的架构有所了解,跟着章节阅读会获得更深的体验。

本书结构

全书 9 个部分,26 章,按 Agent 的概念层次从内到外展开:

Part I 什么是 Harness -- 建立心智模型

Part II Agent Loop -- 核心循环

Part III 工具系统 -- Agent 的手和脚

Part IV 安全与权限 -- Agent 的缰绳

Part V 多智能体 -- 从个体到团队

Part VI Prompt 与记忆 -- Agent 的灵魂和笔记本

Part VII 扩展机制 -- 开放的 Agent

Part VIII 前沿与哲学 -- 设计原则的提炼

Part IX 从理论到实践 -- OpenHarness 实战部署

每章末尾有思考题,引导读者将源码中的设计决策推广到自己的场景。

目录

Part I: 什么是 Agent Harness

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 1 | 从 LLM 到 Agent:Harness 的角色 | LLM 缺什么?Harness 补了什么? |

| Chapter 2 | 系统全景:一个 Agent 的解剖图 | 架构分层与数据流动 |

Part II: Agent Loop -- 循环的艺术

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 3 | Agent Loop 解剖:一轮对话的完整旅程 | 从用户输入到最终回复发生了什么? |

| Chapter 4 | 与 LLM 对话:API 调用、流式响应与错误恢复 | 怎么调 API?出错怎么办? |

| Chapter 5 | 上下文窗口管理:有限记忆下的生存之道 | 对话太长怎么压缩? |

Part III: 工具系统 -- Agent 的手和脚

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 6 | 工具的设计哲学:接口、注册与调度 | 一个工具怎么设计和注册? |

| Chapter 7 | 40 个工具巡礼:从文件读写到浏览器 | 每类工具的设计取舍 |

| Chapter 8 | 工具编排:并发、流式进度与结果预算 | 多工具怎么并行?结果太大怎么办? |

Part IV: 安全与权限 -- Agent 的缰绳

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 9 | 权限模型:三层防线的设计 | 四级权限如何协作? |

| Chapter 10 | 风险分级与自动审批 | ML 分类器怎么判断安全? |

| Chapter 11 | Hooks:可编程的安全策略 | 用户怎么自定义权限规则? |

Part V: 多智能体 -- 从独行侠到团队

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 12 | 子 Agent 的诞生:fork、隔离与通信 | 怎么创建和管理子 Agent? |

| Chapter 13 | 协调者模式:四阶段编排法 | 多 Agent 如何分工协作? |

| Chapter 14 | 任务系统:后台并行的基础设施 | 后台任务怎么创建和监控? |

| Chapter 15 | Team 与 Swarm:群体智能的实现 | Team 怎么组建?消息怎么路由? |

Part VI: System Prompt 工程

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 16 | System Prompt 的组装流水线 | 静态 vs 动态?怎么缓存? |

| Chapter 17 | 记忆系统全景:从文件发现到梦境整合 | 五层发现、四类记忆、自动提取、相关性检索、Dream 整合 |

Part VII: 扩展机制 -- 开放的 Agent

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 18 | MCP:连接外部世界的协议 | 5 种传输、认证、工具发现 |

| Chapter 19 | Skills:用户自定义能力 | Skill 怎么加载和执行? |

| Chapter 20 | Commands 与 Plugin 体系 | CLI 命令和插件怎么协作? |

Part VIII: 前沿与哲学

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 21 | Dream 系统:会「睡觉」的 Agent | 后台记忆整合怎么实现? |

| Chapter 22 | 设计哲学:构建可信 AI Agent 的原则 | 10 条通用 Agent 设计原则 |

Part IX: 从理论到实践 -- OpenHarness

| 章节 | 标题 | 核心问题 |

|---|---|---|

| Chapter 23 | 四根支柱:从 Harness 模式到部署架构 | 前 22 章的模式如何映射到 CONSTRAIN / INFORM / VERIFY / CORRECT? |

| Chapter 24 | 沙箱与安全:在云上约束 Agent | 双 Pod 沙箱如何用 K8s NetworkPolicy 实现最小权限? |

| Chapter 25 | 自修复循环:让 Agent 从失败中学习 | CI 失败后如何自动检测、修复、重试、升级? |

| Chapter 26 | 从零部署:你的第一个 Agent Harness | 双 Agent 模式 + 任务队列 + 成本模型的完整部署 |

附录

| 附录 | 标题 | 内容 |

|---|---|---|

| Appendix A | 架构总览图与数据流图 | 6 张 ASCII 架构图 |

| Appendix B | 关键类型定义速查 | 10 个核心 TypeScript 类型 |

| Appendix C | Feature Flag 完整清单 | 89 编译时 + 18 运行时 + 41 环境变量 |

| Appendix D | 从零构建 Mini Agent Harness | 100 行代码实战教程 |

统计

- 26 章 + 4 附录 = 30 个文件

- 基于对大规模 TypeScript 代码库的深度架构分析

- Part I-VIII 聚焦 Harness 内部设计模式

- Part IX 展示如何用开源组件将模式落地到 AWS 云平台

- 每章对应具体架构模块和设计决策

- 每章附 思考题

- 引用 50+ 权威来源,包括 Anthropic、OpenAI、AWS、LangChain、Andrew Ng 等

参考来源

详见 参考文献

FAQ

What is an AI Agent Harness?

An Agent Harness is the runtime infrastructure that wraps around a Large Language Model (LLM) to create a production-grade AI Agent. It includes tool systems (40+ tool designs analyzed in this book), permission models (4-layer security with ML classifiers), memory management (5-layer discovery with 4 memory types), multi-agent orchestration (fork/isolate/communicate patterns), and error recovery mechanisms. According to our analysis of production Agent systems like Claude Code, Cursor, and Devin, the Harness constitutes approximately 99% of the codebase while the LLM integration is only about 1%. As Andrej Karpathy noted, if the LLM is the "new OS kernel," then the Harness is the entire operating system built around it.

How is this book different from other AI Agent resources?

Most resources on AI Agents focus on Prompt Engineering and API usage -- teaching you how to use Agent frameworks. OpenBook goes deeper: it opens the black box of Agent frameworks themselves, revealing the design patterns used in production systems. The book covers 26 chapters across 9 parts, analyzing patterns from tool registration and scheduling, to multi-agent coordination (Swarm, Mailbox patterns), to MCP protocol internals (5 transport types, authentication, tool discovery), to cloud deployment with dual-Pod sandboxes on Kubernetes. As Anthropic's "Building Effective Agents" guide states: "The most successful implementations aren't using complex frameworks -- they're using simple, composable patterns." This book catalogs those patterns.

Who should read OpenBook?

OpenBook is designed for: (1) AI application developers building Agent products who need production-grade Harness design patterns, (2) Software architects evaluating Agent frameworks like LangChain, CrewAI, or AutoGen who need to understand underlying principles beyond API docs, (3) LLM researchers interested in how model capabilities are amplified (or constrained) through engineering, and (4) Technical professionals who want to understand how real AI Agents (Cursor, Claude Code, Devin) actually work beyond demos. No prior knowledge of any specific Agent system's source code is required.

What is the MCP Protocol covered in this book?

The Model Context Protocol (MCP) is an open standard for connecting AI Agents to external tools and data sources. Chapters 18-20 provide a deep dive covering 5 transport types (stdio, HTTP+SSE, WebSocket, etc.), authentication mechanisms, tool discovery protocols, the Skills system for user-defined capabilities, and the Commands/Plugin architecture. This is one of the most comprehensive technical analyses of MCP available in book form.

Can I deploy what I learn?

Yes. Part IX (Chapters 23-26) is entirely focused on practical deployment. It covers the Four Pillars framework (CONSTRAIN/INFORM/VERIFY/CORRECT), dual-Pod sandbox architecture using Kubernetes NetworkPolicy for least-privilege isolation, self-healing loops for automatic failure detection and recovery, and a complete deployment guide for your first Agent Harness on AWS. Appendix D provides a hands-on 100-line code tutorial to build a Mini Agent Harness from scratch.

Keywords

AI Agent Agent Harness Agent Framework Agent Architecture LLM Large Language Model Multi-Agent MCP Protocol Model Context Protocol Agent Security Agent Tools Agent Memory Agent Orchestration AWS Bedrock Kubernetes Claude Code Cursor Devin LangChain CrewAI AutoGen OpenAI Agents SDK Agent Design Patterns Production AI Agent Loop Tool System Permission Model Swarm Skills System

前言

这本书的缘起

2025 年到 2026 年,AI Agent 经历了一场从概念到产品的爆发。

这场爆发的前奏来自行业领袖们不约而同的判断。Sam Altman 宣称 Agent 将成为 AI 的杀手级应用;Dario Amodei 在《Machines of Loving Grace》中描绘了 Agent 深度参与软件工程的未来;Andrew Ng 在多次演讲中反复强调 Agentic Workflow 的核心理念——不是让模型一次性给出答案,而是让它像人类一样迭代:思考、行动、观察、调整。到了 2026 年,各种 Agent 产品已经成为开发者的日常工具,Agent 的时代不再是将来时,而是现在进行时。

市面上讲 AI 的书不缺。讲 Prompt Engineering 的、讲 API 调用的、讲 LangChain 等编排框架的,一搜一大把。但当我们真正打开一个大型生产级 Agent 产品的源码时,发现了一个令人意外的事实:LLM 本身只占代码量的极小部分。一个完整 Agent 系统中约 99% 的代码,在做另一件事——构建围绕 LLM 的运行时框架。

Andrej Karpathy 曾将 LLM 类比为「新的操作系统内核」。如果 LLM 是内核,那么工具系统是系统调用,权限模型是访问控制,上下文管理是内存管理,多 Agent 编排是进程调度。这整套包裹在 LLM 外层的基础设施,我们称之为 Harness。

Agent = LLM + Harness

LLM 提供推理能力,Harness 提供工具、权限、记忆、编排。几乎所有人都在谈论等号左边的 Agent 和右边的 LLM,但很少有人系统地讲清楚 Harness 到底怎么造。这本书要填补的,正是这个空白。

我们分析了一个日活数百万开发者、每周产生超过 3400 万次子 Agent 调用的生产级系统。它不是一个框架的 demo,不是一篇论文的 proof-of-concept,而是一个在真实世界中承受了海量用户考验的完整产品。它的代码库覆盖了 Agent Harness 的每一个关键维度——从核心循环到工具系统,从权限模型到多智能体编排,从记忆机制到生态扩展。

打开这个代码库的那一刻,我们意识到:这里藏着的不是某个产品的实现细节,而是一整套构建可信 AI Agent 的工程方法论。踩过的坑、做过的权衡、选择的架构模式,是任何教科书和论文无法替代的实战经验。它值得被系统地梳理、抽象、分享出来。

于是有了这本书。

一本关于「第二个 99%」的书

需要澄清一个可能的误解:这不是一本关于某个特定产品的书。

我们分析的系统是一个案例,但本书的目标是提炼出通用的 Agent Harness 设计模式。就像《设计模式》一书分析了 Smalltalk 和 C++ 的代码,但提炼出的 23 个模式适用于所有面向对象语言一样——权限的四层纵深防御、子 Agent 的 fork 隔离、System Prompt 的静态/动态分区、上下文的多层压缩策略,这些模式不绑定特定语言或框架。

如果你用 Python 写 Agent,书中的伪代码不会妨碍你理解。如果你用 Go 或 Rust 写 Agent,底层的架构原则同样适用。我们关注的不是「这个系统是怎么做的」,而是「构建 Agent Harness 时,有哪些问题必须面对,有哪些久经考验的解法」。

业界常说 AI 应用开发中「最后 1% 的模型能力需要 99% 的工程量来释放」。这本书讲的就是那个 99%。

谁应该读这本书

我们为四类读者写了这本书。每类读者关心的问题不同,能从中获得的收获也不同。

AI 应用开发者。 你正在或即将构建自己的 Agent 产品。你需要回答的问题不是「怎么调 API」,而是「怎么设计一个工具系统让 40 个功能各异的工具统一管理」「怎么在 200K token 的上下文窗口里管理不断膨胀的对话历史」「怎么让多个 Agent 并行工作又互不干扰」。本书从生产级代码中提炼出的设计模式和架构决策,会成为你避开弯路的地图。重点阅读 Part II(Agent Loop)、Part III(工具系统)和 Appendix D(动手构建 Mini Harness)。

架构师。 你的职责是评估和选择 Agent 框架,或者为团队设计 Agent 基础设施。你需要的不是框架的 API 文档,而是框架背后的设计原理——为什么权限要分四层?为什么子 Agent 要用 fork 而不是从零创建?为什么 System Prompt 要拆成静态和动态两半?理解了这些「为什么」,你才能在 LangChain、CrewAI、AutoGen 等框架之间做出知情决策,或者自信地决定自己造轮子。重点阅读 Part I(心智模型)、Part IV(安全与权限)和 Chapter 22(设计哲学)。

LLM 研究者。 你关注的是模型能力如何通过工程手段被放大或约束。一个纯推理引擎如何通过 Harness 获得行动能力?提示词工程的边界在哪里,什么时候必须靠代码而非 prompt 来约束行为?协调者模式为什么要剥夺 Coordinator 的工具使用权,用架构约束替代提示词劝说?这些问题的答案分布在 Part V(多智能体)、Part VI(Prompt 与记忆)和 Part VIII(前沿与哲学)中。

对 AI Agent 好奇的技术人员。 你用过各种 Agent 产品,惊叹于它们的能力,但好奇「这到底是怎么做到的」。你想超越 Demo 和 Prompt Engineering,看看一个真正的 Agent 在引擎盖下是什么样子。本书不预设你读过任何源码,每章都从一个直觉性的问题出发,用类比和叙事引导理解。从 Chapter 1 开始顺序阅读即可。

你不需要是 TypeScript 专家。书中所有代码示例都是伪代码,重在传达思路而非编译通过。但如果你有 Web 开发或系统编程的背景,对异步编程、事件驱动和进程模型有基本了解,阅读体验会更流畅。

如何阅读本书

全书 8 个 Part,22 章加 4 个附录。每章围绕一个核心问题展开,具有一定的独立性。但章节之间存在依赖关系——后面的章节建立在前面章节引入的概念之上。

我们提供三条推荐阅读路径,适合不同的时间预算和目标。

路径一:快速了解(4 章,约 3 小时)

如果你只想在一个下午建立对 Agent Harness 的整体认知:

Chapter 1 --> Chapter 3 --> Chapter 6 --> Chapter 22

Chapter 1 建立「Agent = LLM + Harness」的心智模型。Chapter 3 带你走完一轮完整的 Agent 循环。Chapter 6 解剖工具系统的接口设计。Chapter 22 提炼七条设计原则。四章读完,你对 Agent Harness 的核心架构和设计哲学已有清晰的图景。

路径二:深入 Agent 核心(Part I --> Part II --> Part III,顺序阅读)

如果你准备构建自己的 Agent,需要深入理解核心机制:

从 Part I 开始建立全局认知,然后进入 Part II 理解 Agent Loop 的完整生命周期(API 调用、流式响应、上下文管理),再到 Part III 掌握工具系统的设计、注册、调度和编排。这三个 Part 共 8 章,构成了 Agent Harness 的骨架。

读完后根据需要选读:对安全感兴趣继续 Part IV,对多 Agent 编排感兴趣跳到 Part V。

路径三:实战优先

如果你是「先动手再看书」的类型:

Appendix D --> Chapter 3 --> Chapter 6 --> Chapter 9 --> 其余章节

先跟着 Appendix D 从零构建一个 Mini Agent Harness——10 行代码的最简循环,逐步加入工具、权限、多轮对话。动手的过程中你会产生很多「为什么要这样设计」的疑问,然后带着这些疑问回到对应章节,理解会深刻得多。

关于每章的结构

每一章遵循「问题 --> 思路 --> 实现」的三段式结构(少数章节根据内容略有变化):

- 问题:一个具体的工程困境,读者可以先想想自己会怎么做

- 思路:设计者的思考路径,为什么选这个方案而不是其他方案

- 实现:用伪代码展示关键逻辑,源码只是验证思路的证据

每章末尾附有思考题,将该章的设计决策推广到你自己的场景。这些思考题不是考试题——没有标准答案,但认真想一想,你会发现很多设计取舍在不同场景下有完全不同的最优解。

一些阅读建议

无论你选择哪条路径,以下建议可能有帮助:

- 带着问题读。 每章开头的核心问题不是修辞——在看答案之前先想想自己会怎么设计。你的直觉方案和系统实际方案的差异,往往是最有教学价值的部分。

- 不要跳过类比。 书中大量使用了日常类比(机场安检、餐厅分工、员工手册)来解释技术概念。这些类比不是文学装饰,而是帮助你建立直觉模型的脚手架。

- 关注「违反会怎样」。 很多章节不只讲「应该怎么做」,还讲「如果不这样做会出什么问题」。理解反面案例往往比理解正面方案更能加深认知。

- 动手验证。 如果某个设计模式让你觉得「这样做真的有必要吗」,试试用 Appendix D 的 Mini Harness 改改看。实验出真知。

本书的方法论

Anthropic 的 "Building Effective Agents" 指南开篇说过:"The most successful implementations we've seen aren't using complex frameworks -- they're using simple, composable patterns." 本书遵循同样的理念。

我们不是在罗列代码。 这不是一本源码注释集。源码是证据,不是阅读的主体。我们的任务是从数万行 TypeScript 中提炼出可迁移的设计模式和工程决策。

我们用伪代码而非真实代码。 真实代码绑定语言特性、框架版本和工程细节,它们对理解设计思想是噪音。伪代码保留核心逻辑,去掉不相关的实现细节,让 Python 开发者、Go 开发者、Rust 开发者都能读懂。

我们讲「为什么」而不只是「是什么」。 技术书籍最常见的缺陷是描述了系统做了什么,却不解释为什么做了这些选择。每一个架构决策都有它的上下文:什么约束迫使了这个选择?考虑过哪些替代方案?选择的代价是什么?「违反会怎样」往往比「应该怎样」更有教学价值。

我们追求可迁移性。 本书分析的是一个特定系统,但目标是让读者能将其中的模式应用到自己的场景中。权限的四层防线、子 Agent 的 fork 隔离、System Prompt 的静态/动态分区、上下文的多层压缩策略——这些模式不依赖于特定的语言或框架。你用 Python 写 Agent,用 Go 写 Agent,甚至用 Rust 写 Agent,这些模式同样适用。

我们承认局限。 本书基于对一个特定时间点的代码库的分析。软件在持续演进,某些实现细节在你阅读时可能已经改变。但我们刻意将关注点放在设计原则和架构模式上,而非实现细节上——原则的半衰期远长于代码。

我们重视叙事。 技术写作不等于枯燥。每一章都从一个具体的、读者能感同身受的困境出发——「你让 Agent 整理项目结构,它执行了 rm -rf /」「你的上下文窗口在 30 轮对话后爆了」「三个子 Agent 同时写同一个文件」。我们相信好的技术叙事能让复杂概念变得直觉化,而直觉化的理解比死记硬背更持久。

全书结构一览

Part I 什么是 Harness 2 章 建立心智模型

Part II Agent Loop 3 章 核心循环的生命周期

Part III 工具系统 3 章 Agent 的手和脚

Part IV 安全与权限 3 章 Agent 的缰绳

Part V 多智能体 4 章 从个体到团队

Part VI Prompt 与记忆 2 章 灵魂和笔记本

Part VII 扩展机制 3 章 开放的 Agent

Part VIII 前沿与哲学 2 章 设计原则的提炼

附录 A-D 4 篇 架构图、类型速查、Feature Flag、实战教程

八个 Part 的组织逻辑是从内到外:先理解 Agent 的心跳(循环),再看它怎么和外部世界交互(工具),然后是约束(权限)、协作(多 Agent)、记忆(Prompt 与状态)、扩展(生态),最后上升到设计哲学。

四个附录各有分工:Appendix A 提供六张 ASCII 架构图供随时查阅;Appendix B 汇总了十个核心 TypeScript 类型定义,是阅读伪代码时的速查手册;Appendix C 完整列出了系统的 Feature Flag 清单(89 个编译时 + 18 个运行时 + 41 个环境变量),展示了大型 Agent 系统的可配置性;Appendix D 是从零构建 Mini Agent Harness 的实战教程——从 10 行代码的最简循环,逐步加入工具注册、权限检查、多轮对话和上下文管理,最终得到一个可运行的 Mini Harness。

这本书不是什么

为了避免期望错位,有必要说明本书不是什么:

- 不是 API 使用教程。 不会教你怎么调用某个 LLM 的 API。市面上有大量这类教程,本书假设你已经知道如何发起一次 API 调用。

- 不是框架使用指南。 不会教你怎么用 LangChain 或 CrewAI 搭建工作流。本书讲的是框架本身是怎么造的,而不是怎么用框架。

- 不是学术论文。 不追求严格的形式化证明或数学推导。本书是工程实践的提炼,追求的是实用性和可操作性。

- 不是特定产品的使用手册。 虽然分析了一个具体的系统,但目标是提炼通用模式,不是教你使用那个产品。

如果用一句话概括本书的定位:这是一本关于如何为 LLM 构建生产级运行时框架的工程方法论著作。

排版约定

本书使用以下排版约定:

- 等宽字体 用于代码、命令、文件名和技术术语(如

AsyncGenerator、tool_use) - 粗体 用于首次出现的关键概念

- 引用块用于重要论断或来自业界的引述

- 伪代码块标注「概念示意」,表明这不是可编译的代码,而是传达设计意图

- 每章末尾的思考题以灰色框呈现

致谢

这本书的诞生,依赖于整个 AI 研究和开源社区的集体贡献。

感谢 Transformer 架构的发明者们,让大语言模型成为可能。感谢 OpenAI、Anthropic、Google DeepMind 等机构的研究者们,持续推动模型能力的边界。感谢 Andrew Ng、Andrej Karpathy、Harrison Chase 等研究者和实践者,他们的公开演讲和技术文章为 Agent 工程奠定了概念基础。

感谢 MCP(Model Context Protocol)的设计者,定义了 Agent 连接外部世界的开放标准。感谢 LangChain、CrewAI、AutoGen、OpenAI Agents SDK 等框架的开发者,他们的工作让整个社区受益,也为本书的分析提供了丰富的对比视角。

感谢开源精神。本书分析的核心对象是一个生产级系统的架构模式。我们无意复制或泄露任何私有实现,所有代码示例都是为教学目的创作的伪代码。我们的目标是让这些来之不易的工程经验成为公共知识的一部分,帮助更多人构建更好的 Agent 产品。

感谢每一位早期读者和审校者。你们尖锐而中肯的反馈让每一章都变得更清晰、更准确、更有用。正是这些反馈让我们意识到,哪些地方的类比选得不够贴切,哪些地方的伪代码省略了关键步骤,哪些地方的论证跳跃了逻辑环节。

感谢我们的家人和朋友,在无数个深夜和周末给予的理解与支持。写一本技术书籍的时间成本远超预期——但每当收到读者的正面反馈,就觉得一切值得。

最后,感谢你——读者。你愿意花时间深入 Agent 的引擎盖下面,而不是停留在表面的 API 调用,这本身就是对工程卓越的追求。AI Agent 的时代才刚刚开始,最好的 Agent 产品还没有被写出来。也许它就在你读完这本书之后诞生。

希望这本书能成为你构建 AI Agent 之路上的有用参考。

「理解了 Harness 怎么造,你才真正理解了 Agent 是什么。」

如果你在阅读过程中发现错误、有改进建议,或者想分享你基于本书模式构建的 Agent 项目,欢迎通过本书的开源仓库提交反馈。好的技术书籍不是写出来的,是迭代出来的——就像好的 Agent 一样。

让我们开始吧。

翻到 Chapter 1,看看一个只能思考的大脑,是如何长出双手、长出眼睛、戴上缰绳,变成一个能行动的 Agent 的。

二零二六年春 于无数个与 AI Agent 对话的深夜之后

导读图:全书地图与推荐路径

全书结构关系图

┌─────────────────────────┐

│ Part I: 心智模型 │

│ Ch 1-2 │

│ Agent = LLM + Harness │

└────────────┬────────────┘

│

┌────────────────┼────────────────┐

│ │ │

v v v

┌───────────────┐ ┌─────────────────┐ ┌──────────────┐

│ Part II: │ │ Part III: │ │ Part IV: │

│ Agent Loop │ │ 工具系统 │ │ 安全与权限 │

│ Ch 3-5 │ │ Ch 6-8 │ │ Ch 9-11 │

│ 核心循环 │ │ 手和脚 │ │ 缰绳 │

└───────┬───────┘ └────────┬────────┘ └──────┬───────┘

│ │ │

└──────────┬───────┘ │

│ │

v │

┌─────────────────────┐ │

│ Part V: │<──────────────┘

│ 多智能体 │

│ Ch 12-15 │

│ 从个体到团队 │

└──────────┬──────────┘

│

┌────────────┼────────────┐

│ │

v v

┌─────────────────┐ ┌─────────────────┐

│ Part VI: │ │ Part VII: │

│ Prompt 与记忆 │ │ 扩展机制 │

│ Ch 16-17 │ │ Ch 18-20 │

│ 灵魂和笔记本 │ │ 开放的 Agent │

└────────┬────────┘ └────────┬────────┘

│ │

└───────────┬────────────┘

│

v

┌─────────────────────┐

│ Part VIII: │

│ 前沿与哲学 │

│ Ch 21-22 │

│ 设计原则的提炼 │

└─────────────────────┘

│

v

┌─────────────────────┐

│ Appendix A-D │

│ 架构图 / 类型速查 │

│ Feature Flag / │

│ Mini Harness 实战 │

└─────────────────────┘

八个 Part 的一句话摘要

| Part | 主题 | 一句话摘要 |

|---|---|---|

| I | 什么是 Harness | LLM 是大脑,Harness 是身体——理解这个等式是理解一切的起点 |

| II | Agent Loop | Agent 的心跳:消息进入、LLM 思考、工具执行、结果观察、循环往复 |

| III | 工具系统 | 40 个工具如何统一接口、按需注册、并发调度、控制输出预算 |

| IV | 安全与权限 | 四层纵深防御:工具自检、规则引擎、ML 分类器、用户审批 |

| V | 多智能体 | 从 fork 隔离到协调者编排,从后台任务到 Team 群体智能 |

| VI | Prompt 与记忆 | System Prompt 的静态/动态流水线,五层记忆文件的发现与整合 |

| VII | 扩展机制 | MCP 协议连接外部世界,Skills 安装专业知识,Commands 统一交互入口 |

| VIII | 前沿与哲学 | Dream 后台认知模式,七条从代码中提炼的 Agent 设计原则 |

三条推荐路径

路径一:速览(4 章 / 约 3 小时)

建立整体认知,适合技术决策者和好奇者。

Ch 1 ──> Ch 3 ──> Ch 6 ──> Ch 22

心智模型 核心循环 工具设计 设计哲学

路径二:深入 Agent 核心(8 章 / 约 8 小时)

掌握构建 Agent 的核心知识,适合开发者和架构师。

Part I Part II Part III

Ch 1 -> Ch 2 -> Ch 3 -> Ch 4 -> Ch 5 -> Ch 6 -> Ch 7 -> Ch 8

全景认知 Agent Loop 全貌 工具系统全貌

| |

v v

(可选) Part IV (可选) Part V

Ch 9-11 Ch 12-15

安全与权限 多智能体编排

路径三:实战优先(动手 + 按需阅读)

先写代码再看原理,适合「Learning by Doing」风格的读者。

Appendix D ──> Ch 3 ──> Ch 6 ──> Ch 9 ──> 按需选读

Mini Harness 对照理解 对照理解 对照理解

(动手构建) 循环机制 工具机制 权限机制

章节依赖速查

- Part I 是所有后续 Part 的基础,建议优先阅读

- Part II 和 Part III 互相独立,可并行阅读,但 Part V 依赖两者的概念

- Part IV 可独立阅读,但 Chapter 11(Hooks)与 Part VII 的扩展机制有呼应

- Part V 依赖 Part II(循环)和 Part III(工具)的概念

- Part VI 可在任何时候阅读,但 Chapter 17(记忆)与 Chapter 21(Dream)紧密关联

- Part VII 的 MCP(Ch 18)可独立阅读,Skills(Ch 19)和 Commands(Ch 20)相互关联

- Part VIII 是全书的总结和升华,建议放在最后阅读

- Appendix D 可在任何时候动手实践

Part I: 什么是 Agent Harness

建立心智模型:LLM 不等于 Agent,Harness 是让 LLM 变成 Agent 的那层壳。

这个 Part 要解决什么问题

在深入任何一个子系统之前,你需要一张地图。

LLM 能写诗、能推导公式、能生成排序算法——但它不能读你的文件,不能执行命令,不能记住上一轮对话,更不知道什么操作不该做。这些缺陷不是 bug,而是设计边界。要让 LLM 变成有用的 Agent,必须有一层系统来补全这些缺陷。这层系统就是 Harness。

Part I 的任务是建立这个核心心智模型:Agent = LLM + Harness,然后带你鸟瞰一个生产级 Harness 的完整架构——六层模型、数据流向、模块划分。这两章不涉及任何子系统的深入分析,但它们提供的全局视角是理解后续所有章节的基础。

包含章节

Chapter 1: 从 LLM 到 Agent -- Harness 的角色。 LLM 有四个致命缺陷(没有手、没有眼、没有记忆、没有缰绳),Harness 如何逐一补全?工具系统、上下文注入、对话管理和权限守卫分别扮演什么角色?这一章用最直觉的方式建立 Harness 的概念框架。

Chapter 2: 系统全景 -- 一个 Agent 的解剖图。 面对一个拥有 40 多个目录和数百个源文件的代码库,怎么不迷路?六层架构模型(入口层、引擎层、工具层、状态层、服务层、表现层)如何分工?一条消息从用户输入到最终回复经历了怎样的九阶段旅程?

与其他 Part 的关系

- 前置知识:无。这是全书的起点。

- 后续延伸:Part I 建立的心智模型和架构全景,是 Part II(Agent Loop)、Part III(工具系统)和 Part IV(安全与权限)的共同基础。Chapter 2 中描述的「一条消息的旅程」将在 Part II 中被逐步展开为完整的工程实现。

Chapter 1: 从 LLM 到 Agent -- Harness 的角色

一个只能思考的大脑,如何变成一个能行动的 Agent?

┌──────────────────── Agent ────────────────────┐

│ │

│ ┌───────┐ ┌─────────────────────┐ │

│ │ │ │ │ │

│ │ LLM │◀─────▶│ ★ H A R N E S S ★ │ │

│ │ (推理) │ │ │ │

│ └───────┘ │ 工具 · 权限 · 记忆 │ │

│ ~1% 代码 │ 编排 · 扩展 · 上下文 │ │

│ └─────────────────────┘ │

│ ~99% 代码 │

└───────────────────────────────────────────────┘

本章聚焦:Harness 的角色 -- 它补全了 LLM 的哪些缺陷

1.1 LLM 的四个致命缺陷

问题

假设你拥有一个读过几乎所有公开书籍、代码和论文的大脑。它能写诗、推导公式、生成排序算法。但如果你要求它"把这段代码写进 auth.ts",它会面临一个尴尬的事实:它做不到。

不是能力不够,而是结构性缺陷。LLM 作为纯推理引擎,有四个致命的短板:

- 没有手:能描述操作步骤,但无法执行任何一条命令、写入任何一个字节。

- 没有眼:对你的文件系统、Git 状态、运行环境一无所知。每次对话都从零开始。

- 没有记忆:每次 API 调用都是无状态的。除非你把历史对话重新喂回去,它连自己上一句话说了什么都不知道。

- 没有缰绳:它可能建议你执行

rm -rf /,但完全没有"应不应该执行"的判断力。

思路

这四个缺陷不是 LLM 的 bug,而是它的设计边界。LLM 被设计为一个纯函数:输入 token 序列,输出 token 序列,无副作用。这个设计是正确的 -- 一个能直接操作文件系统的语言模型会带来灾难性的安全风险。

但这也意味着,要让 LLM 变成有用的 Agent,必须有另一层系统来补全这些缺陷。这就是 Harness。

1.2 Harness:让大脑长出身体

问题

如何把一个"只能想不能动"的推理引擎,变成一个能读文件、写代码、执行命令的 Agent?

思路

答案是一个精确的等式:

Agent = LLM + Harness

Harness 不参与"思考"。它不生成文本,不做推理。它的全部工作是:让 LLM 的思考能够落地。 具体来说,它补全了 LLM 的四个缺陷:

| LLM 的缺陷 | Harness 的补全 | 该系统的实现 |

|---|---|---|

| 没有手 | 工具系统 | 40+ 个 Tool(Bash、FileEdit、Grep...) |

| 没有眼 | 上下文注入 | 系统提示词 + AGENT.md + 环境感知 |

| 没有记忆 | 对话管理 | 消息历史维护 + 自动压缩 |

| 没有缰绳 | 权限守卫 | 每个工具调用前的权限检查 |

这个设计类比 CSS 的层叠模型可能更好理解:LLM 提供默认行为(生成文本),Harness 在上面叠加了一层又一层的能力增强和行为约束,最终组合出 Agent 的完整行为。

实现

翻开该系统的代码库,你会发现它几乎不包含任何 LLM 相关的模型代码。没有训练、没有推理、没有权重文件。整个代码库的全部工作就是构建 Harness -- 这一点从目录结构就一目了然。LLM 被当作一个外部服务通过 API 调用,而 Harness 就是围绕这个 API 调用构建的一整套 TypeScript 运行时系统。

1.3 给 LLM 装上双手:工具系统

问题

LLM 通过 API 返回的 tool_use 块表达意图("我想读取这个文件"),但谁来把意图变成行动?

思路

该系统采用了一种注册表模式:所有工具实现同一接口,统一注册到工具列表中,由运行时根据 LLM 的意图调度执行。这种设计的好处是工具可以无限扩展,而核心循环不需要修改。

关键的设计决策是:每个工具必须实现权限检查,这不是可选项。

// 工具接口的核心方法(简化示意)

Tool = {

name: String

execute(args, context) -> ToolResult // 执行操作

checkPermissions(input, ctx) -> PermResult // 权限检查(必须实现)

isReadOnly(input) -> Boolean // 是否只读

inputValidator: SchemaDefinition // 输入校验规则

}

输入校验器同时承担运行时验证和类型推断。这意味着 LLM 生成的参数在执行前必须通过严格校验 -- LLM 说"读取 /etc/passwd",校验器先验证参数格式,权限检查方法再验证权限,都通过了执行方法才执行。三道关卡,缺一不可。

实现

工具覆盖了软件开发的完整生命周期。从工具注册模块中可以看到全貌:文件读写(FileRead、FileEdit、FileWrite)、命令执行(Bash)、代码搜索(Grep、Glob)、子 Agent 派发(Agent)、网络获取(WebFetch、WebSearch)等。总计超过 40 个工具,每个都是一个独立目录,包含实现、提示词和常量定义。

1.4 给 LLM 装上安全围栏:权限守卫

问题

LLM 可能在任何时候决定执行 rm -rf ~ 或者读取你的 SSH 私钥。工具系统给了它手,但谁来确保这双手不会惹祸?

思路

权限系统的设计哲学是默认保守。看工具构建工厂函数提供的默认值就明白了:

// 工具默认安全属性

TOOL_DEFAULTS = {

isConcurrencySafe: (input?) -> false // 默认不可并行

isReadOnly: (input?) -> false // 默认非只读

isDestructive: (input?) -> false // 默认无破坏性

// ...

}

isConcurrencySafe 默认 false -- 除非工具主动声明自己是并发安全的,否则系统假设它不安全。这是典型的安全优先设计:宁可牺牲性能,也不冒险。

权限检查支持多种模式(default、auto、plan 等),可以通过配置文件设定 always-allow、always-deny、always-ask 规则。这意味着即使 LLM "想要"执行一个危险操作,Harness 也可以拦截、询问用户、或直接拒绝。

实现

权限系统的上下文类型揭示了它的丰富程度:

// 权限上下文定义(简化示意)

ToolPermissionContext = Immutable({

mode: PermissionMode

alwaysAllowRules: RulesBySource

alwaysDenyRules: RulesBySource

alwaysAskRules: RulesBySource

isBypassPermissionsModeAvailable: Boolean

// ...

})

规则来源是分层的(用户设置、项目设置、策略设置),不同来源的规则有不同的优先级 -- 再次类比 CSS 层叠,企业策略覆盖项目配置,项目配置覆盖用户偏好。

1.5 给 LLM 装上记忆:上下文管理

问题

LLM 每次 API 调用都是无状态的。如何让它在一个持续的编程任务中保持上下文?

思路

Harness 负责维护对话历史,并在每次 API 调用时把完整上下文传递给 LLM。这个"上下文"不只是用户消息,还包括:

- 系统提示词 -- 告诉 LLM 它的身份、能力范围和行为规范

- 工具调用结果 -- 每次工具执行的输入和输出

- AGENT.md 内容 -- 项目级的自定义指令(类似

.editorconfig对编辑器的作用) - 自动压缩 -- 对话太长时自动摘要,保持在上下文窗口内

最后一点尤其关键。LLM 的上下文窗口有限,而编程任务的对话可以非常长(读几十个文件、执行十几条命令)。自动压缩机制在对话接近上下文上限时触发,把历史消息压缩为摘要,既保留关键信息又腾出空间。这就像操作系统的虚拟内存 -- 把不常用的页换出到磁盘,给活跃页腾空间。

1.6 给 LLM 成长空间:扩展机制

问题

40 个内置工具覆盖了软件开发的常见场景,但世界在变化。你的团队可能需要调用内部 API、查询私有数据库、集成特定的 CI/CD 系统。Harness 能只靠内置能力吗?

思路

该系统的 Harness 提供了四种扩展机制,按侵入性从低到高排列:

- MCP (Model Context Protocol) -- 通过标准协议连接外部工具和数据源。MCP 服务器可以用任何语言编写,通过 stdio 或 SSE 与 Agent 通信。这是最推荐的扩展方式,因为它完全解耦 -- MCP 服务器对 Agent 的内部实现一无所知。

- Skills -- 可复用的提示词模板,教会 Agent 新的"技能"。比如一个 Skill 可以教 Agent 如何按照团队规范写代码评审。Skills 不涉及代码执行,只是结构化的上下文注入。

- Hooks -- 在工具执行的特定时刻(

PreToolUse、PostToolUse等)插入自定义逻辑。类比 Git 的 pre-commit hook -- 不改变核心流程,但能在关键时刻做拦截和增强。 - Plugins -- 最深层的扩展点。插件可以注册新工具、新命令、新 MCP 服务器,甚至修改权限规则。该系统有完整的插件生命周期管理:安装、启用、禁用、更新、市场分发。

这个四层扩展体系的设计哲学是渐进式侵入。大多数用户的需求可以通过 MCP 或 Skills 满足(零侵入),只有深度定制才需要 Hooks 或 Plugins。

实现

扩展机制的状态管理分散在两层。在启动状态模块中跟踪已注册的 Hooks 和已调用的 Skills:

// 启动状态中的扩展追踪

registeredHooks: Map<HookEvent, List<HookMatcher>> or null

invokedSkills: Map<String, { skillName, content, agentId }>

在应用状态存储模块中跟踪 MCP 连接和 Plugin 状态:

// 应用状态中的扩展追踪

mcp: { clients: List<MCPConnection>, tools: List<Tool>, commands: List<Command> }

plugins: { enabled: List<Plugin>, disabled: List<Plugin>, errors: List<PluginError> }

Hooks 的键是 agentId:skillName -- 这意味着主 Agent 和子 Agent 的 Skills 是隔离的,不会相互覆盖。子 Agent 不会因为调用了同名 Skill 而把主 Agent 的 Skill 上下文覆盖掉。

1.7 从入口文件第一行看工程素养

问题

以上是 Harness 的抽象能力。但一个工业级的 Harness 还需要什么?

思路

打开入口文件的前几十行,你看到的不是通常的 import 列表,而是一个精心编排的并行启动序列:

// 入口文件启动序列注释(概念示意)

// 以下副作用必须在所有其他导入之前运行:

// 1. 性能检查点标记,在重量级模块加载之前记录时间

// 2. 启动配置预读子进程,与后续约 135ms 的导入并行执行

// 3. 启动凭证预取操作(OAuth + 传统 API 密钥),并行读取

代码在 import 语句之间穿插了副作用调用 -- 配置预读取和凭证预取操作被插在模块加载之间。为什么?因为模块加载需要约 135ms,而这两个操作是 I/O 密集型的,可以利用模块加载的等待时间并行执行。

在模块加载完成后,代码标记了一个性能检查点:

// 模块加载完成后的性能标记

markCheckpoint('imports_loaded')

这种对启动时间毫秒级的优化,是工业级 Harness 的第一个特征。

实现

真正的初始化在初始化模块中。这个函数被 memoize 包装确保只执行一次,内部的序列揭示了 Harness 需要管理多少基础设施:

// 初始化模块(关键步骤概览)

init = memoize(async function():

enableConfigs() // 加载配置系统

applySafeEnvironmentVariables() // 安全环境变量

applyExtraCACerts() // TLS 证书(必须在首次握手前)

setupGracefulShutdown() // 注册优雅退出

configureGlobalMTLS() // mTLS 配置

configureGlobalAgents() // HTTP 代理

preconnectApi() // API 预连接

)

注意第三步的注释:

// 将自定义 CA 证书在任何 TLS 连接之前应用到进程环境中。

// Bun 运行时使用 BoringSSL,在启动时缓存 TLS 证书存储,

// 因此证书设置必须在首次 TLS 握手之前完成。

Bun 使用 BoringSSL 并在启动时缓存 TLS 证书存储。如果在首次 TLS 握手之后才设置自定义证书,证书将永远不会生效。这种对运行时细节的深入理解,是 Harness 工程化的另一个特征:你不只要让功能跑起来,还要理解底层运行时的行为时序。

API 预连接也值得留意 -- 它在配置 CA 证书和代理之后,预先发起 TCP+TLS 握手(耗时 100-200ms),让这个时间与后续的 action handler 初始化重叠。这是一种经典的延迟隐藏技术。

1.8 生命周期的完整管理

问题

Harness 不只管启动。当进程退出时,遥测数据、会话记录等需要被正确持久化。如果进程被 Ctrl+C 杀死,这些数据怎么办?

思路

初始化模块中的优雅退出机制看似平淡,实则至关重要。它注册了进程退出时的清理逻辑。再往下看,清理注册贯穿整个初始化流程:

// 清理回调注册示例

registerCleanup(shutdownLspServerManager)

registerCleanup(async function():

// 动态导入团队清理模块(延迟加载)

teamHelpers = await dynamicImport('teamHelpers')

await teamHelpers.cleanupSessionTeams()

)

LSP 服务器管理器、子 Agent 创建的 Team 文件、遥测数据 -- 所有需要在退出时清理的资源都通过清理回调注册。注意 Team 清理使用了 lazy import,因为 swarm 代码在 feature gate 后面,大多数会话不会加载它 -- 清理代码也遵循同样的懒加载原则。

遥测系统的初始化更体现了对用户隐私的尊重:遥测初始化函数只在用户接受信任对话框之后才启动遥测收集。这是合规驱动的设计 -- 在用户同意之前,一个字节的遥测数据都不会被收集。

1.9 小结

LLM 是一个强大但受限的推理引擎。Harness 的角色是消除这些限制:

- 工具系统给了 LLM 双手

- 上下文管理给了 LLM 记忆

- 权限守卫给了 LLM 缰绳

- 扩展机制(MCP、Skills、Hooks、Plugins)给了 LLM 成长空间

从工程角度看,该系统的 Harness 远不是简单的胶水层。它包含了性能工程(并行预取、API 预连接)、安全工程(多层权限检查、默认保守策略)、可靠性工程(优雅退出、运行时时序感知)和隐私工程(信任后才采集遥测)。

在下一章,我们将从高空俯瞰整个代码库的全景图,建立对 40 个目录和核心数据流的整体认知。

给读者的思考题

-

Harness 的权限系统采用"默认保守"策略(默认不可并行、默认非只读)。如果换成"默认宽松"会带来什么问题?在什么场景下默认宽松可能更合适?

-

入口文件在 import 语句之间穿插副作用调用来实现并行启动。这种写法违反了"import 应该无副作用"的常见约定。你认为这种权衡是否合理?在什么情况下启动时间的优化值得打破惯例?

-

该系统的遥测初始化被延迟到用户接受信任对话框之后。如果你在设计一个开源的 Agent 框架,你会如何设计遥测的 opt-in/opt-out 机制?

Chapter 2: 系统全景 -- 一个 Agent 的解剖图

40 个目录怎么分层?一条消息从输入到输出经过哪些模块?

★ 本章视角:从高空俯瞰全部六层 ★

┌─────────────────────────────────┐

│ 入口层 CLI 解析、模式选择 │

├─────────────────────────────────┤

│ 引擎层 Agent Loop 主循环 │

├─────────────────────────────────┤

│ 工具层 40+ 工具实现 │

├─────────────────────────────────┤

│ 状态层 全局状态 / UI 状态 │

├─────────────────────────────────┤

│ 服务层 API / MCP / 压缩 │

├─────────────────────────────────┤

│ 表现层 终端 UI (Ink) │

└─────────────────────────────────┘

本章聚焦:六层架构全景与一条消息的完整旅程

2.1 建立全景认知

问题

打开该系统的代码库,你面对的是一个庞大的 TypeScript 工程:40+ 个顶级目录,数百个源文件。如果没有一张"地图",你很容易迷失在某个工具的实现细节里,而忘记整体架构。

思路

理解一个复杂系统,最有效的方法不是从头到尾阅读每个文件,而是先建立分层认知。该系统的架构可以用一个六层模型概括:

入口层 入口模块 CLI 解析、模式选择

引擎层 查询引擎 查询生命周期、Agent 主循环

工具层 工具定义与实现 与外部世界的交互接口

状态层 启动状态管理 全局状态、会话管理

服务层 服务模块 API 通信、MCP、压缩、分析

表现层 UI 组件 终端 UI(React + Ink)

这六层之间的依赖关系是自上而下的:入口层调用引擎层,引擎层调度工具层,工具层依赖服务层,表现层消费状态层。反向依赖极少。

这个分层和 Web 应用的经典架构(Controller - Service - Repository)异曲同工,但多了两个 Agent 特有的层:引擎层(Agent 循环)和工具层(外部世界交互)。理解了这一点,你就可以把该系统当作一个"会调 API 的 Web 应用"来理解,只是它的"用户请求"来自 LLM 的 tool_use 响应。

2.2 一条消息的旅程

问题

当你在终端输入 "fix the bug in auth.ts" 并按下回车,数据经历了怎样的旅程?这个问题的答案就是 Agent 的心跳。

思路

Agent 的核心是一个循环:思考 -> 行动 -> 观察 -> 再思考。这个循环不是隐喻,而是查询模块中循环函数的字面实现。

整个数据流可以分为 9 个阶段:

- 用户输入 -- 消息被封装为 UserMessage

- 路由 -- 斜杠命令走命令处理器,普通文本走查询流程

- 上下文拼装 -- 系统提示词 + 对话历史 + 工具定义 + AGENT.md

- API 调用 -- 通过 Anthropic SDK 发送流式请求

- 响应解析 -- 纯文本渲染给用户,tool_use 进入工具执行

- 权限检查 -- 每个工具调用前执行权限校验

- 工具执行 -- 调用工具执行方法,执行实际操作

- 结果回注 -- 工具结果封装为 tool_result,追加到消息历史

- 循环判断 -- end_turn 则结束,否则回到步骤 3

关键洞察:步骤 3-8 构成了一个循环。LLM 看到工具执行结果后,可能决定调用更多工具("读了 auth.ts 发现需要同时改 utils.ts"),直到它认为任务完成,发出 end_turn。

这个循环在查询模块中实现为一个 AsyncGenerator,通过 yield 逐步产出事件,让调用方可以流式消费。

实现

查询循环函数维护一个可变的状态对象在迭代间传递状态:

// 查询循环的可变状态

state = {

messages: params.messages,

toolUseContext: params.toolUseContext,

autoCompactTracking: undefined,

maxOutputRecoveryCount: 0,

hasAttemptedReactiveCompact: false,

turnCount: 1,

transition: undefined,

}

注意 turnCount 和 maxOutputRecoveryCount -- 前者追踪循环轮次(对应最大轮数限制),后者追踪输出截断错误的恢复尝试次数。循环在四个条件之一满足时停止:LLM 发出 end_turn、达到最大轮数、不可恢复的 API 错误、用户中断。

transition 字段记录"上一轮为什么继续",这个设计让测试可以断言恢复路径是否正确触发,而不需要检查消息内容。

2.3 入口层

问题

一个支持交互模式、非交互模式、SDK 模式、MCP 服务模式的 CLI 程序,入口怎么组织?

思路

入口模块选择了 Commander.js 来声明式地定义 CLI。这不是一个小决策 -- 它意味着所有子命令(mcp serve、plugin install、auth login 等数十个)都在同一个地方注册,形成了一个集中的路由表。

但入口模块最精妙的设计在于初始化时机的控制。它使用 Commander 的 preAction hook 来延迟初始化:

// 使用 preAction hook 延迟初始化(概念示意)

// 只在真正执行命令时初始化,显示帮助时不触发

program.hook('preAction', async (thisCommand):

await Promise.all([ensureSettingsLoaded(), ensureCredentialsPrefetched()])

await init()

)

如果用户只是运行 agent --help,不需要加载配置、连接 API、初始化遥测。preAction hook 确保只在真正执行命令时才触发昂贵的初始化。这是一个微小但务实的优化。

实现

入口模块的核心决策点 -- 判断是交互模式还是非交互模式:

// 入口模块的模式判断(概念示意)

hasPrintFlag = cliArgs.includes('-p') or cliArgs.includes('--print')

hasInitOnlyFlag = cliArgs.includes('--init-only')

hasSdkUrl = cliArgs.any(arg -> arg.startsWith('--sdk-url'))

isNonInteractive = hasPrintFlag or hasInitOnlyFlag or hasSdkUrl or !stdout.isTTY

四种情况被判定为非交互:-p 标志、--init-only 标志、SDK URL 模式、或者标准输出不是 TTY。交互模式最终调用 REPL 入口,非交互模式走查询引擎的 headless 路径。

这里有一个有趣的循环依赖处理。入口模块顶部有几个延迟加载:

// 通过延迟加载打破循环依赖(概念示意)

getTeammateUtils = () -> lazyRequire('utils/teammate')

getTeammatePromptAddendum = () -> lazyRequire('utils/swarm/teammatePromptAddendum')

getTeammateModeSnapshot = () -> lazyRequire('utils/swarm/backends/teammateModeSnapshot')

原因是模块之间存在循环依赖链。用 lazy require 打破它,同时利用编译时宏做死代码消除(DCE) -- 如果特性未开启,相关代码直接从 bundle 中消失。

2.4 引擎层:查询引擎

问题

Agent 主循环(思考-行动-观察)的代码放在哪里?谁负责驱动这个循环?

思路

该系统用了两层抽象:查询引擎类管理会话生命周期,查询函数实现单次查询的循环。

查询引擎的核心方法是一个 AsyncGenerator -- 通过 yield 逐步产出 SDK 消息,让调用方流式消费。这个设计让 REPL(交互)和 Headless(非交互)可以用不同的方式消费同一个引擎:REPL 在每个 yield 点更新 UI,Headless 在每个 yield 点输出 JSON。

查询所需的全部输入通过参数类型清晰列出:

// 查询参数定义(概念示意)

QueryParams = {

messages: List<Message>

systemPrompt: SystemPrompt

userContext: Map<String, String>

systemContext: Map<String, String>

canUseTool: PermissionCheckFunction

toolUseContext: ToolUseContext

maxTurns?: Number

taskBudget?: { total: Number }

// ...

}

这个类型就像是 Agent 循环的"契约":消息历史、系统提示词、用户上下文、工具权限函数、最大轮数、预算限制 -- 驱动一次查询所需要的一切,都在这里。

2.5 状态层:两个"大脑"

问题

Agent 运行时需要大量状态信息 -- 会话 ID、累计成本、当前工作目录、遥测计数器、权限配置。这些状态怎么组织?

思路

该系统把状态分成了两个层次:

- 启动状态模块 -- 会话级全局状态,模块单例,被整个系统读取

- 应用状态存储 -- UI 级应用状态,React 组件树消费

为什么要分两层?因为它们的消费者不同。启动状态被 CLI 逻辑、工具实现、服务模块等非 UI 代码读取,它不能依赖 React。应用状态存储被 Ink 组件消费,它通过 useSyncExternalStore 实现精确的状态订阅和最小化重渲染。

这类似于后端应用中"进程级配置"和"请求级上下文"的分离 -- 前者在启动时确定,全局共享;后者随每个请求变化,线程隔离。

实现

启动状态模块最令人印象深刻的不是它的 250+ 个字段,而是它的三重警告:

// 启动状态模块中的三重警告(概念示意)

// 类型定义前:

// "DO NOT ADD MORE STATE HERE - BE JUDICIOUS WITH GLOBAL STATE"

// 初始化函数前:

// "ALSO HERE - THINK THRICE BEFORE MODIFYING"

// 单例声明前:

// "AND ESPECIALLY HERE"

STATE = getInitialState()

类型定义前、初始化函数前、单例声明前 -- 三个位置都有注释阻止随意添加字段。这说明维护者深知全局状态是 bug 的温床:任何一个角落的修改都可能影响系统的其他部分。

全局状态的 API 设计也体现了这种谨慎。所有字段通过 getter/setter 函数暴露,而非直接导出状态对象:

// 通过 getter 封装全局状态(概念示意)

function getSessionId() -> SessionId:

return STATE.sessionId

function getOriginalCwd() -> String:

return STATE.originalCwd

这种封装确保了两件事:(1) 外部代码不能意外修改状态;(2) 将来需要在状态变更时触发副作用(日志、遥测),只需修改 setter 函数。这是经典的"为变化而设计"。

应用状态存储则使用了深度不可变包装确保 React 组件不会意外修改状态:

// 应用状态定义(概念示意)

AppState = DeepImmutable({

settings: SettingsJson

verbose: Boolean

mainLoopModel: ModelSetting

toolPermissionContext: ToolPermissionContext

// ...

}) merged with {

tasks: Map<taskId, TaskState> // 可变:含函数类型

mcp: { clients, tools, ... }

}

注意可变部分 -- 包含函数类型的字段被排除在深度不可变之外。这是一个务实的权衡:TypeScript 的 Readonly 无法很好地处理函数类型的递归冻结,强制使用会导致类型体操而非实际保护。

2.6 状态里藏的设计决策

问题

启动状态模块的 250+ 个字段里,藏着很多非显而易见的设计决策。

思路

让我挑几个有意思的字段:

Prompt Cache 的稳定性锁存(Latch)。 状态中有四个锁存字段:

// Prompt Cache 锁存字段(概念示意)

afkModeHeaderLatched: Boolean or null

fastModeHeaderLatched: Boolean or null

cacheEditingHeaderLatched: Boolean or null

thinkingClearLatched: Boolean or null

为什么需要"锁存"?因为 Anthropic API 的 prompt cache 对请求参数敏感 -- 如果 beta header 在会话中途变化(比如 auto mode 被用户临时关闭又打开),会导致 50-70K token 的 prompt cache 失效,下一次请求要从头重建缓存。锁存机制的作用是:一旦某个 beta 特性在会话中首次激活,即使用户后来关闭了它,HTTP header 仍然继续发送,避免 cache bust。

这是一个性能 > 语义纯粹性的权衡。从语义上说,关闭了功能就不应该发送 header;但从性能上说,一次 cache miss 的代价(重新处理 50K+ token)远大于一个冗余 header 的开销。

交互时间的延迟更新。 交互时间更新函数有一个 immediate 参数:

// 交互时间延迟更新(概念示意)

function updateLastInteractionTime(immediate?: Boolean):

if immediate:

flushInteractionTimeInner()

else:

interactionTimeDirty = true

默认情况下,交互时间标记只是设置一个 dirty flag,在下一次 Ink render 时批量刷新。这避免了每次按键都调用 Date.now()。但在 React useEffect 回调中(Ink 渲染周期之后执行),必须传 immediate = true,否则时间戳会停留在上一帧。

这种精细的时序控制是终端 UI 性能优化的缩影 -- 终端不像浏览器有 60fps 的固定刷新率,每一次不必要的 Date.now() 都会增加事件循环的压力。

2.7 服务层和工具层的全景

问题

状态层之外,还有两个"重量级"的层:服务层和工具层。它们各自负责什么?

思路

服务层封装了所有外部通信和系统级功能:

| 服务 | 职责 |

|---|---|

| API 服务 | Anthropic API 客户端、重试、日志 |

| MCP 服务 | MCP 协议实现(客户端、配置、认证、传输) |

| 压缩服务 | 上下文压缩(自动/手动/微压缩) |

| 分析服务 | 遥测(Statsig、GrowthBook、DataDog) |

| 认证服务 | OAuth 认证流程 |

| 插件服务 | 插件管理和安装 |

工具层包含了所有工具的实现。每个工具是一个独立目录:

| 工具 | 文件数 | 复杂度来源 |

|---|---|---|

| BashTool | 10+ 个子模块 | 权限分析、沙箱、语义检查、破坏性命令警告 |

| AgentTool | 12+ 个子模块 | 内存快照、颜色管理、fork、内置 Agent 定义 |

| FileEditTool | 5 个文件 | 差异计算、类型检查、提示词 |

| FileReadTool | 4 个文件 | 图片处理、PDF、大小限制 |

BashTool 和 AgentTool 的复杂度远超其他工具 -- 前者因为 shell 命令的安全风险极高,需要多层防护;后者因为子 Agent 管理涉及独立的对话上下文、内存隔离和生命周期控制。

2.8 技术栈选择背后的意图

问题

为什么是 TypeScript + React + Bun?这些选择不是偶然的。

思路

每个选择都有明确的工程意图:

TypeScript -- 类型安全是复杂 Agent 系统的生命线。工具定义中的泛型类型确保每个工具的输入、输出、权限检查都在编译期被验证。在一个有 40+ 工具、250+ 全局状态字段的系统中,没有类型系统就是在裸奔。

React + Ink -- Ink 让你用 React 组件写终端 UI。这意味着 90+ 个 UI 组件(对话框、Diff 视图、进度条、权限提示)都是声明式的,而不是手工操作终端转义码。声明式 UI 在状态频繁变化的场景下(Agent 循环中不断有新消息、工具结果、进度更新)优势巨大。

Bun -- 启动速度显著快于 Node.js。更重要的是编译时宏:

// 编译时特性门控(概念示意)

coordinatorModeModule = FEATURE('COORDINATOR_MODE')

? require('coordinator/coordinatorMode') : null

assistantModule = FEATURE('KAIROS')

? require('assistant/index') : null

编译时宏在构建时被求值,未启用的特性对应的代码(连同它的整个依赖树)直接从 bundle 中消除。这不只是节省文件大小 -- 它确保了未启用特性的代码不会被解析、不会被加载、不会增加模块评估时间。

Zod -- 每个工具的输入校验器同时提供运行时验证和 TypeScript 类型推断。LLM 生成的工具参数在执行前必须通过 Zod 验证 -- 这是防止 LLM "幻觉"参数的最后一道防线。

OpenTelemetry -- 遥测采集使用 OTLP 标准。但它的加载被刻意延迟:

// 遥测模块延迟加载(概念注释)

// 遥测初始化通过动态 import() 延迟加载,

// 以推迟约 400KB 的 OpenTelemetry + protobuf 模块。

// gRPC 导出器(约 700KB)进一步延迟加载。

400KB 的 OpenTelemetry + 700KB 的 gRPC -- 超过 1MB 的依赖被延迟到遥测真正初始化时才加载。这种懒加载策略确保用户不会为了遥测功能付出启动时间的代价。

2.9 缺了什么

问题

理解了架构的六层模型和核心数据流后,有一个值得注意的"空白"。

思路

整个代码库几乎没有 LLM 相关的模型代码。没有权重、没有推理引擎、没有 tokenizer 实现。LLM 通过 API 被当作一个黑盒服务调用。

这不是疏忽,而是架构边界的体现。Harness 的职责是让 LLM 的能力落地,而不是实现 LLM 本身。这个分离意味着:如果底层模型提供商明天发布了一个更强的模型,该系统只需要改一个模型名称,整个 Harness 不需要任何修改。

这也解释了为什么启动状态模块中的模型相关字段是一个字符串别名或 null 而不是复杂的模型配置对象 -- Harness 不需要知道模型的内部结构,只需要知道用哪个模型。

2.10 小结

该系统是一个分层清晰的架构。用一句话概括每一层:

- 入口层决定"做什么"(交互还是 headless)

- 引擎层驱动"怎么做"(思考-行动-观察循环)

- 工具层实现"具体做"(读文件、写代码、执行命令)

- 状态层记住"做了什么"(会话状态、UI 状态)

- 服务层支撑"做得好"(API、遥测、压缩、认证)

- 表现层展示"做的结果"(终端 UI)

数据从用户输入开始,经过入口路由、上下文拼装、API 调用、响应解析、权限检查、工具执行,最终渲染结果并回注消息历史,形成 Agent 的主循环。这个循环不断重复,直到 LLM 认为任务完成。

在后续章节中,我们将沿着这个六层模型逐层深入。下一章从工具系统开始 -- Agent 最核心的外部交互能力。

给读者的思考题

-

该系统把全局状态分成了启动状态(会话级)和应用状态存储(UI 级)。如果只用一层状态管理会怎么样?在什么规模的项目中,单层状态管理仍然可行?

-

查询循环使用 AsyncGenerator 实现 Agent 循环。相比普通的 while 循环 + callback,AsyncGenerator 带来了什么优势?它的缺点是什么?

-

启动状态模块有四个 prompt cache 锁存字段,为了避免 cache bust 而在功能关闭后仍然发送 header。你能想到其他领域中类似的"为了缓存一致性而牺牲语义精确性"的设计吗?

Part II: Agent Loop -- 循环的艺术

核心循环:Agent 就是一个 Message --> Think --> Act --> Observe 的循环。理解这个循环,就理解了 AI Agent 的心跳。

这个 Part 要解决什么问题

当你告诉 Agent「帮我重构这个函数」,它不是调一次 API 就完事。它可能要读文件、理解上下文、写代码、跑测试、发现报错、再改代码——一连串动作构成一个循环。这个循环怎么实现?API 怎么调?流式响应怎么处理?错误怎么恢复?对话越来越长、上下文窗口快爆了怎么办?

Part II 拆解 Agent 的心跳。从外层的查询引擎(会话管理、状态维护、预算控制)到内层的查询函数(API 调用、工具执行、循环判断),再到让整个系统能够长期运行的上下文管理机制。三章读完,你将理解一个生产级 Agent 从接收用户输入到产出最终回复的完整生命周期。

包含章节

Chapter 3: Agent Loop 解剖 -- 一轮对话的完整旅程。 为什么把循环拆成两层(查询引擎 + 查询函数)?为什么选择 AsyncGenerator 而不是回调或事件发射器?分层的好处是什么?这一章带你走完循环的每一步。

Chapter 4: 与 LLM 对话 -- API 调用、流式响应与错误恢复。 调一次 API 看似只需三行代码,但生产环境下藏着一百种失败方式:过载、超时、token 超限、服务器错误。流式传输如何让用户不用盯着空白屏幕?自动重试的策略是什么?

Chapter 5: 上下文窗口管理 -- 有限记忆下的生存之道。 200K token 听起来很多,但 Agent 场景下几十分钟就能花光。六层压缩管线——从 microcompact 的精准外科手术到 autocompact 的全量摘要替换——如何用最小代价保持上下文可用?

与其他 Part 的关系

- 前置知识:Part I 中的心智模型和架构全景,特别是 Chapter 2 的「一条消息的旅程」。

- 后续延伸:Agent Loop 是工具执行(Part III)的运行时容器——工具调用发生在循环内部。权限检查(Part IV)嵌入在循环的工具执行阶段。多 Agent 编排(Part V)本质上是多个循环的协调。上下文管理(Chapter 5)与记忆系统(Part VI, Chapter 17)紧密互补。

Chapter 3: Agent Loop 解剖:一轮对话的完整旅程

Agent 的本质就是一个循环。理解这个循环,就理解了 AI Agent 的心跳。

┌─────────────── Harness ───────────────┐

│ │

│ User ──▶ ★ Agent Loop ★ ──▶ LLM │

│ │ ▲ │

│ Tool Use Result │

│ ▼ │ │

│ [ Tools ] ──┘ │

│ │

└───────────────────────────────────────┘

本章聚焦:Agent Loop 的内部结构

3.1 Agent 不是一问一答

问题

当你在终端敲下"帮我重构这个函数",该 Agent 系统不是简单地调一次 API 返回答案。它可能要读文件、理解上下文、写代码、执行测试、发现报错、再改代码......这一连串动作怎么串起来?

思路

学术界有一个被广泛接受的 Agent 模型:Message -> Think -> Act -> Observe -> Loop (or Stop)。翻译成人话:接收指令、思考做什么、执行动作、观察结果、决定继续还是停下。

该系统忠实地实现了这个模型,但加了一层关键的工程抽象:把整个循环拆成两层。外层查询引擎负责"会话生命周期"——状态管理、消息录制、预算控制;内层查询函数负责"单轮推理循环"——调 API、执行工具、决定是否继续。

这就像一家餐厅:查询引擎是前厅经理,负责接待顾客、记账、控制翻台率;查询函数是厨房,负责实际做菜。前厅不关心菜怎么做,厨房不操心账怎么算。

实现

这种分层体现在代码结构上。查询引擎类拥有会话状态:

// 查询引擎的核心状态(概念示意)

class QueryEngine:

private mutableMessages: List<Message>

private abortController: AbortController

private totalUsage: UsageAccumulator

// ...

一个查询引擎实例对应一个完整对话。每次提交消息开启一轮新的交互,但消息历史、Token 用量、文件缓存都跨轮持久化。

而具体的推理循环,提交消息方法交给查询函数去做:

// 查询引擎流式消费查询循环(概念示意)

for await (message in query({

messages, systemPrompt, userContext, systemContext,

canUseTool: wrappedCanUseTool,

// ...

})):

// 处理每条从查询循环产出的消息

注意这里用的是 for await...of。这不是一次性拿到结果,而是流式消费——查询函数每产出一条消息,查询引擎就处理一条。这个设计决策的意义我们稍后会看到。

3.2 AsyncGenerator:为什么选这个模式?

问题

消息在系统里怎么流动?为什么不用回调、事件发射器或 Promise?

思路

该系统面临一个独特的挑战:消息的种类繁多(LLM 输出、工具结果、流式事件、进度报告、系统通知......),而且消费者的节奏和生产者不同。UI 需要逐字显示,日志需要完整记录,SDK 调用者需要结构化数据。

AsyncGenerator 恰好解决这个问题。生产者(查询函数)通过 yield 推送消息,消费者(查询引擎)按自己的节奏拉取。这形成了一条背压友好的管道:如果消费者处理不过来,生产者自然暂停。

更巧妙的是,AsyncGenerator 支持嵌套组合。循环函数 yield 给查询函数,查询函数 yield 给引擎的提交方法,提交方法 yield 给外部调用者。每一层可以拦截、转换、过滤消息,而不破坏流式语义。

实现

查询函数的签名揭示了这条管道的类型:

// 查询函数签名(概念示意)

async generator function query(params: QueryParams):

yields:

StreamEvent // LLM 流式输出的增量片段

| RequestStartEvent // 一次 API 请求即将开始

| Message // 完整的 assistant/user 消息

| TombstoneMessage // 标记需要删除的孤儿消息

| ToolUseSummary // 工具使用摘要

returns:

Terminal // 终止原因

五种产出类型,一种返回类型。产出是"过程中的事件",返回是"最终的结论"。

查询引擎的消息分发器则根据类型做不同处理:assistant 消息推入历史并转发,stream_event 用于追踪 Token 用量,system 消息处理压缩边界和 API 错误,等等。每种消息类型都有明确的职责,互不干扰。

3.3 循环的心脏:while(true)

问题

查询函数内部的循环到底怎么运转?一轮迭代做了什么?

思路

真正的循环逻辑在循环函数里。这是一个 while(true) 无限循环——听起来危险,但其实很合理:Agent 不知道要调多少次工具才能完成任务,循环次数由 LLM 的决策动态决定。

每轮迭代可以概括为五步:预处理上下文 -> 调 API -> 处理响应 -> 执行工具 -> 决定是否继续。但魔鬼在细节里——每一步都有大量的边界情况处理。

循环通过一个状态对象管理跨迭代的状态:

// 循环状态定义(概念示意)

LoopState = {

messages: List<Message>

turnCount: Number

maxOutputRecoveryCount: Number

hasAttemptedReactiveCompact: Boolean

transition: ContinueReason or undefined // 上一次迭代为什么继续

// ...

}

transition 字段特别值得注意。它记录了循环继续的原因:next_turn(正常工具调用后继续)、max_output_tokens_recovery(输出被截断,恢复重试)、reactive_compact_retry(上下文过长,压缩后重试)。这不只是调试信息——它让每轮迭代知道自己是"正常的下一步"还是"某种异常恢复",从而调整行为。

实现

循环开头有一个关键步骤:上下文预处理管线。消息在到达 API 之前要过好几道工序:

原始消息 -> compactBoundary截断 -> toolResultBudget -> snipCompact

-> microcompact -> contextCollapse -> autoCompact -> API

这条管线的存在是因为 Agent 的上下文增长速度远超聊天场景。每次工具调用都会注入几百到几千 token 的输出。不经过压缩,几十轮交互就能撑爆 200K 的窗口。第 5 章会详细展开这个话题。

循环体内,API 调用和工具执行之间有一个精妙的优化——流式工具并行执行。当 LLM 流式输出中出现一个完整的 tool_use block 时,不等整个响应结束就开始执行:

// 流式工具并行执行(概念示意)

if streamingToolExecutor and not aborted:

for each toolBlock in messageToolUseBlocks:

streamingToolExecutor.addTool(toolBlock, message)

想象 LLM 说"我要同时读三个文件"。传统方式是等 LLM 说完,再依次读取。流式执行则在 LLM 还在输出第二个 tool_use block 时,第一个文件已经开始读了。在多文件操作场景下,这能显著缩短延迟。

3.4 循环怎么知道该停?

问题

Agent Loop 不能永远转下去。什么时候停?谁来决定?

思路

终止条件的设计体现了一个原则:多重保险。不能只靠一个条件来停止循环,因为任何单一机制都可能失效。该系统至少有七种终止方式,分布在查询函数和查询引擎两层。

最核心的判断很简单:LLM 的回复里有没有 tool_use block。有就继续(needsFollowUp = true),没有说明 LLM 认为任务完成了。但即使 LLM 说"我做完了",还要过一关——Stop Hooks。

实现

needsFollowUp 的赋值逻辑在流式处理中:

// 判断是否需要后续循环(概念示意)

toolUseBlocks = message.content.filter(block -> block.type == 'tool_use')

if toolUseBlocks.length > 0:

allToolUseBlocks.append(toolUseBlocks)

needsFollowUp = true

当 needsFollowUp 为 false 时,循环在结束前会经过 Stop Hooks 检查:

// Stop Hooks 检查(概念示意)

stopHookResult = yield* handleStopHooks(

messagesForQuery, assistantMessages, ...

)

if stopHookResult.preventContinuation:

return { reason: 'stop_hook_prevented' }

Stop Hooks 是用户自定义的验证逻辑。比如"每次写代码后必须跑测试"——如果 LLM 写了代码但没跑测试就要停下,Hook 会阻止终止,注入一条错误消息让循环继续。

在查询引擎层面还有额外的硬性限制:

- USD 预算:累计花费达到上限时立即终止

- 最大轮数:轮数超出设定值时终止

- 结构化输出重试上限:JSON Schema 验证失败超 5 次时终止

这些是"断路器"——防止 Agent 因为 LLM 幻觉或 Hook 死循环而无限运转。

3.5 从用户输入到 API 调用之间

问题

用户敲下一句话到第一次 API 调用之间,发生了什么?

思路

在调用查询函数之前,查询引擎做了大量准备工作。这些看似琐碎的初始化步骤实际上决定了整个对话的"人格"和"能力范围"。

最重要的一步是用户输入处理。它把原始用户输入转化为结构化数据,处理斜杠命令、附件、模型切换等。返回值中的 shouldQuery 标志决定了是否需要调用 LLM——如果用户输入的是 /compact 或 /model,本地就能处理,不用花钱调 API。

另一个关键步骤是系统提示词的组装。该系统的 System Prompt 不是一段静态文本,而是从三个来源并行拉取、分层组合的:

- defaultSystemPrompt:工具说明、行为规范等固定内容

- userContext:AGENT.md 内容、环境信息——注入到消息最前面

- systemContext:系统级指令——追加到系统提示词末尾

这种分层设计是为 Prompt Caching 服务的。系统提示词保持稳定,变化的 userContext 放在消息里,这样 API 服务端可以复用缓存的前缀,节省大量 token 计费。

实现

权限检查的包装也值得一提。原始的权限检查函数被包了一层:

// 权限检查包装(概念示意)

wrappedCanUseTool = async function(tool, input, ...):

result = await canUseTool(tool, input, ...)

if result.behavior != 'allow':

this.permissionDenials.append({

tool_name: tool.name,

tool_use_id: toolUseID,

tool_input: input,

})

return result

每次权限拒绝都被记录下来,最后通过 result 消息返回给 SDK 调用者。这不是可选的诊断——在 SDK 场景下,调用者需要知道哪些操作被拒了,以便决定是否调整权限策略。

3.6 状态的流转全景

把整个流程串起来,一轮完整的"用户说帮我读 package.json"涉及以下状态流转:

用户输入

|

v

processUserInput() --> shouldQuery=true

|

v

组装系统提示词 + 用户上下文

|

v

query() 循环 ---- 第 1 轮迭代 ----

| 上下文预处理管线

| 调 LLM API(流式)

| LLM 决定调 Read 工具 --> needsFollowUp=true

| 权限检查 --> allow

| 执行 Read,读到文件内容

| yield user message(tool_result)

|

| state.transition = { reason: 'next_turn' }

|

v ---- 第 2 轮迭代 ----

| 上下文预处理管线(含文件内容)

| 调 LLM API(流式)

| LLM 生成最终回复,无 tool_use --> needsFollowUp=false

| Stop Hooks 检查 --> 允许结束

| return { reason: 'completed' }

|

v

QueryEngine 产出 result { subtype: 'success' }

两次 API 调用,两轮循环。第一轮 LLM 决定行动,第二轮 LLM 基于观察生成回答。这就是 Think-Act-Observe 模型的具体实例。

3.7 小结

该系统的 Agent Loop 有三个核心设计决策:

-

两层架构。查询引擎管生命周期,查询函数管推理循环。职责分离让每一层都可以独立演进。

-

AsyncGenerator 管道。消息在循环函数 -> 查询函数 -> 查询引擎 -> 调用者之间流式传递,天然支持背压和中间处理。

-

多重终止保险。LLM 决策、Stop Hooks、轮数限制、USD 预算——四道防线确保循环不会失控。

理解了这个循环,后面两章就是深入它的两个关键部件:怎么跟 LLM 对话(第 4 章),以及对话太长时怎么压缩(第 5 章)。

思考题

-

为什么

transition字段要记录循环继续的原因?如果只用一个 booleanshouldContinue会有什么问题? -

流式工具并行执行(StreamingToolExecutor)在什么场景下反而可能更慢?提示:考虑工具执行需要权限确认的情况。

-

查询引擎的消息数组在压缩边界之后会被截断。为什么要这么做?这对 GC 有什么影响?

Chapter 4: 与 LLM 对话:API 调用、流式响应与错误恢复

调一次 API 看似只需三行代码。但在生产环境下,这三行代码后面藏着一百种失败方式。

┌─────────────── Harness ───────────────┐

│ │

│ Agent Loop │

│ │ │

│ ▼ │

│ ★ API 通信层 ★ ─────▶ LLM 服务 │

│ ┌───────────────────────┐ │

│ │ 流式传输 · 重试策略 │ │

│ │ 错误恢复 · 模型降级 │ │

│ │ Token 预算 · Prompt 缓存│ │

│ └───────────────────────┘ │

│ │

└───────────────────────────────────────┘

本章聚焦:Agent 与 LLM 之间的可靠通信

4.1 流式传输:为什么不等结果出来再显示

问题

LLM 生成一段回复可能需要 5-30 秒。如果等它完全生成好再一次性返回,用户会盯着一个空白屏幕发呆。有没有更好的方式?

思路

答案是流式传输(streaming)。LLM 边生成边发送,用户能看到文字逐字出现。这不只是体验问题——在 Agent 场景下,流式传输还有一个关键用途:让工具执行和 LLM 输出并行。

LLM 的 API 返回一系列事件:message_start -> content_block_start -> content_block_delta(多次) -> content_block_stop -> message_delta -> message_stop。每个 content_block_delta 携带一小段增量内容(一个文本片段、一段 JSON 碎片、一段思考过程)。

该系统在 API 服务模块中提供了两个入口函数:一个流式版本(AsyncGenerator,逐步产出事件),一个非流式版本(返回 Promise,用于不需要实时反馈的场景如压缩对话)。两者共享同一个底层实现,区别只是消费方式不同。

实现

在查询引擎的消息分发器中,流式事件被逐一处理。最重要的是 Token 用量追踪:

// 流式事件中的 Token 用量追踪(概念示意)

case 'stream_event':

if event.type == 'message_start':

currentMessageUsage = EMPTY_USAGE

currentMessageUsage = updateUsage(currentMessageUsage, event.message.usage)

if event.type == 'message_delta':

currentMessageUsage = updateUsage(currentMessageUsage, event.usage)

if event.type == 'message_stop':

totalUsage = accumulateUsage(totalUsage, currentMessageUsage)

message_start 重置计数器,message_delta 累加增量,message_stop 写入总账。这种三阶段追踪确保了即使流式传输中途出错,已经消耗的 Token 也不会被遗漏。

流式传输还带来了一个巧妙的优化机会:前面第 3 章提到的 StreamingToolExecutor。当 LLM 流式输出中出现一个完整的 tool_use block,不必等整个响应结束就可以开始执行工具。在流式循环中间就取回已完成的工具结果:

// 流式执行中取回已完成结果(概念示意)

if streamingToolExecutor and not aborted:

for result in streamingToolExecutor.getCompletedResults():

if result.message:

yield result.message

toolResults.append(...)

LLM 还在输出第三个工具调用,第一个工具的结果已经拿到了。这种重叠执行在"同时读三个文件"的场景下效果显著。

4.2 重试:从简单退避到分级策略

问题

网络抖动、API 限速、服务端过载——这些是调 API 的家常便饭。一个简单的"失败就重试"够用吗?

思路

不够。盲目重试有两个致命问题。第一,如果所有客户端在同一时刻重试,会制造"惊群效应"(thundering herd),把本来快恢复的服务再次压垮。第二,不是所有错误都值得重试——401 认证失败重试一百次也没用,而 529 过载可能等 30 秒就好。

该系统的重试引擎采用了经典的指数退避 + 随机抖动,但在此基础上叠加了三层差异化策略:按错误类型、按请求来源、按运行模式。

最有趣的设计是:重试引擎本身也是一个 AsyncGenerator。重试等待期间,它不是沉默地 sleep,而是 yield 出系统消息,让用户看到"正在重试..."的提示。这解决了一个 UX 问题:用户不知道程序是挂了还是在等。

实现

指数退避的实现:

// 指数退避 + 随机抖动(概念示意)

function getRetryDelay(attempt, retryAfterHeader?, maxDelayMs = 32000):

// 优先使用服务端指定的 retry-after 值

if retryAfterHeader:

seconds = parseInt(retryAfterHeader)

if isValidNumber(seconds): return seconds * 1000

// 指数退避:500ms 起步,每次翻倍,上限 32 秒

baseDelay = min(BASE_DELAY_MS * pow(2, attempt - 1), maxDelayMs)

// 25% 随机抖动,避免客户端同步重试

jitter = random() * 0.25 * baseDelay

return baseDelay + jitter

三个层次:优先服务端 retry-after 头(它知道什么时候能恢复),否则从 500ms 起步、每次翻倍、上限 32 秒,最后加 25% 随机抖动避免客户端同步。

4.3 529 过载:不是所有请求都值得重试

问题

当 LLM API 返回 529(服务端过载),所有请求都应该重试吗?

思路

不应该。这是一个违反直觉但至关重要的设计决策:在服务端过载时,减少请求量比保证每个请求成功更重要。

系统设计者把请求分成两类:前台请求(用户正在等结果的)和后台请求(摘要生成、标题生成、建议等)。后台请求在遇到 529 时直接放弃,因为用户感知不到它们失败,而重试只会加剧过载。

实现

前台请求的来源被明确枚举:

// 允许重试 529 的前台请求来源(概念示意)

FOREGROUND_529_RETRY_SOURCES = Set([

'repl_main_thread', 'sdk', 'agent:custom',

'compact', 'hook_agent', 'auto_mode',

// ...

])

没在这个集合里的来源——提示建议、标题生成、会话记忆等——直接失败。注释里写得很清楚:"每次重试是 3-10 倍的网关放大,用户根本看不到这些失败"。

对于前台请求,连续 3 次 529 后会触发模型降级:

// 模型降级机制(概念示意)

if is529Error(error):

consecutive529Errors++

if consecutive529Errors >= MAX_529_RETRIES:

if options.fallbackModel:

throw FallbackTriggeredError(options.model, options.fallbackModel)

降级错误被外层 try/catch 捕获,切换到备用模型重试。比如 Opus 过载了,降级到 Sonnet——不如原来聪明,但至少能用。

4.4 持久重试:无人值守的韧性

问题

在 CI/CD 或自动化场景下,该 Agent 系统可能无人值守运行几小时。遇到 API 限速怎么办?等多久?

思路

普通场景下,重试 10 次失败就放弃了。但对于无人值守场景(通过环境变量开启),该系统提供了一种"等到天荒地老"的模式。

这里有一个工程细节值得注意:长时间等待期间,宿主环境(比如容器编排系统)可能因为空闲而杀死进程。解决方案是每 30 秒发一次"心跳"。

实现

持久重试的参数设定:

// 持久重试参数(概念示意)

PERSISTENT_MAX_BACKOFF = 5 minutes // 退避上限 5 分钟

PERSISTENT_RESET_CAP = 6 hours // 最长等 6 小时

HEARTBEAT_INTERVAL = 30 seconds // 心跳 30 秒

长时间 sleep 被切成 30 秒的块。每个块结束时 yield 一条系统消息,宿主看到标准输出有活动,就不会判定进程"僵死"。

// 心跳式等待(概念示意)

remaining = delayMs

while remaining > 0:

if signal.aborted: throw UserAbortError()

yield createSystemErrorMessage(error, remaining, attempt, maxRetries)

chunk = min(remaining, HEARTBEAT_INTERVAL)

await sleep(chunk, signal)

remaining -= chunk

429 限速还有一个特殊处理:如果服务端返回了限速重置头(告诉你什么时候限速结束),直接等到那个时间点,而不是傻乎乎地指数退避。窗口式限速(比如"5 小时限额")的重置时间通常是精确的。

4.5 输出被截断:分级恢复

问题

LLM 的输出有长度限制(max_output_tokens)。当输出被截断时(stop_reason === 'max_output_tokens'),Agent 正在写的代码可能写到一半。怎么办?

思路

系统设计者实现了一套三级恢复机制,核心思想是先试最便宜的方案。

第一级:也许根本不需要那么多输出空间。系统默认把输出限额压到 8K,因为数据分析显示 p99 的输出只有约 5000 token。如果触碰了这个低限额,先升级到 64K 重试——一次干净的重试换取 8 倍的容量节约。

第二级:如果 64K 还不够,注入一条特殊消息让 LLM 从断点继续写。最多重试 3 次。

第三级:3 次都失败了,把错误暴露给用户。

实现

第一级升级:

// 输出限额升级(概念示意)

if capEnabled and noOverrideSet:

nextState = {

...state,

maxOutputOverride: ESCALATED_MAX_TOKENS, // 64,000

transition: { reason: 'max_output_escalate' },

}

state = nextState

continue // 用更高限额重试同一个请求

第二级恢复消息的措辞值得细看:

// 截断恢复消息(概念示意)

recoveryMessage = createUserMessage({

content:

"Output token limit hit. Resume directly -- no apology, no recap " +

"of what you were doing. Pick up mid-thought if that is where the " +

"cut happened. Break remaining work into smaller pieces.",

isMeta: true,

})

"No apology, no recap"——这不是礼貌问题,是 Token 预算问题。LLM 有一个坏习惯:被打断后喜欢道歉、总结之前做了什么。这些"客气话"会占用宝贵的输出空间,可能导致再次被截断,形成死循环。

还有一个设计细节:截断错误在流式循环中被"扣留"(withheld),不立即 yield 给外部。如果过早暴露错误,SDK 调用者可能提前终止会话,让恢复机制没机会运行。只有当三次恢复都失败后,错误才被释放。

4.6 Token 预算:三道保险

问题

Token 是 LLM 世界的货币。怎么防止失控的消耗?

思路

该系统在三个维度管控 Token 预算,每个维度解决不同的问题:

- 输出限额(per-request):防止单次回复过长。默认 8K,升级到 64K,上限因模型而异。

- 上下文窗口(per-conversation):防止对话历史撑爆窗口。200K 或 1M,通过压缩机制管理(下一章详述)。

- USD 预算(per-session):防止账单失控。SDK 调用者可以设硬性上限。

实现

输出限额的容量保留优化体现了数据驱动的思维:

// 基于数据分析的输出限额(概念示意)

// 数据分析显示 p99 输出约 4,911 token,32k/64k 默认值会过度预留 8-16 倍

CAPPED_DEFAULT_MAX_TOKENS = 8_000

ESCALATED_MAX_TOKENS = 64_000

不到 1% 的请求会触碰 8K 限额,它们被升级到 64K——代价是一次额外的 API 调用,收益是 99% 的请求省了 8-16 倍的容量预留。

USD 预算控制在查询引擎层面,每处理完一条消息就检查累计花费:

// USD 预算断路器(概念示意)

if maxBudgetUsd != undefined and getTotalCost() >= maxBudgetUsd:

yield { type: 'result', subtype: 'error_max_budget_usd', ... }

return

这是一个硬性断路器。不管 Agent 正在做什么,预算到了立刻停。

4.7 模型选择:运行时的动态决策

问题

不同用户、不同场景应该用什么模型?谁来决定?

思路

模型选择不是启动时一锤子买卖。它有一条优先级链(用户显式指定 > 环境变量 > 订阅级别默认值),并且在运行时可以动态调整。

最有趣的是 opusplan 模式:规划阶段用 Opus(最强大脑),执行阶段用 Sonnet(高效助手)。这是一个成本优化——大部分 Token 消耗在执行阶段(读文件、写代码),用较便宜的模型就够了,把昂贵的模型留给需要深度思考的规划环节。

实现

运行时模型切换的逻辑:

// 运行时模型选择(概念示意)

function getRuntimeMainLoopModel(params):

// opusplan 模式:规划阶段用 Opus,但超长上下文除外

if userSetting == 'opusplan'

and permissionMode == 'plan' and not exceeds200kTokens:

return getDefaultOpusModel()

// haiku 在规划阶段升级到 sonnet(规划能力不足)

if userSetting == 'haiku' and permissionMode == 'plan':

return getDefaultSonnetModel()

return mainLoopModel

注意 exceeds200kTokens 这个条件:当上下文超过 200K token 时,即使在规划阶段也不用 Opus。这是因为 Opus 在超长上下文下的性价比不如 Sonnet,花两倍的钱但不一定得到更好的规划。

另外,Haiku 在规划阶段也会被升级到 Sonnet。逻辑很清楚:Haiku 的规划能力不足以驾驭复杂任务的分解和编排。

4.8 错误分类:每种故障都有对应的出路

问题

API 调用可能遇到几十种不同的错误。怎么给用户有用的提示,而不是千篇一律的"出错了"?

思路

错误处理模块中有一个庞大的错误分类器。它的设计原则是:每种分类对应一种可操作的指引。不是告诉用户"429 错误",而是告诉他"限速了,去 用量设置页面 开启额外用量"。

实现

分类树的主干结构:

超时 --> "Request timed out"(自动重试)

图片过大 --> "Image was too large"(提示缩小)

429 限速 --> 细分:

有 quota headers --> 解析剩余额度,显示重置时间

需要 Extra Usage --> "run /extra-usage to enable"

其他 --> 显示服务端原始消息

Prompt Too Long --> 触发 reactive compact

PDF 错误 --> 细分页数/密码/格式

401/403 认证 --> 细分:

OAuth 撤销 --> "Please run /login"

组织被禁用 --> 区分环境变量 vs OAuth 路径

余额不足 --> "Credit balance is too low"

每个分支产出一个助手消息,带有错误类型标识字段。这个字段被上层的恢复机制消费——比如 prompt_too_long 类型会触发 reactive compact,max_output_tokens 会触发截断恢复。错误分类不只是给人看的提示,更是给机器看的恢复信号。

4.9 Prompt 缓存:省钱的隐形机制

问题

Agent 每轮循环都要把完整的消息历史发给 API。同样的系统提示词发了 50 遍,Token 算了 50 次钱。有没有办法只付一次?

思路

API 提供商的 Prompt Caching 机制允许标记消息中的"缓存断点"。被标记内容的 Token 在第一次请求时正常计费,后续请求如果前缀匹配,只收 1/10 的价格。

该系统在两个地方设置缓存断点:系统提示词和最近几轮对话的消息末尾。这样,只要系统提示词和对话前缀不变,每轮循环只为新增的内容付全价。

缓存的 TTL 默认 5 分钟(ephemeral),但对符合条件的用户可以扩展到 1 小时。TTL 的选择被"锁存"在会话启动时——防止远程配置在请求中途更新,导致同一会话内混用不同 TTL,反而破坏缓存。

实现

缓存控制的生成逻辑:

// 缓存控制生成(概念示意)

function getCacheControl({ scope, querySource }):

return {

type: 'ephemeral',

ttl: should1hCacheTTL(querySource) ? '1h' : undefined,

scope: scope == 'global' ? 'global' : undefined,

}

1 小时 TTL 的判断内部做了两层判断:用户是否有资格(内部用户或订阅且未超量),查询来源是否匹配白名单模式。两者都满足才开启 1h TTL。

这里有一个微妙的稳定性考量:资格和白名单在首次查询时被锁存到启动状态,整个会话不再变化。原因是:"防止在远程配置磁盘缓存在请求中途更新时出现混合 TTL"——如果 TTL 在会话中途从 5min 变成 1h,新请求的 cache_control 和旧请求不同,服务端会认为是新的前缀,之前缓存的内容全部失效。

4.10 小结

与 LLM 对话的可靠性是一门工程纪律,需要在多个维度同时防御:

- 流式传输降低感知延迟,同时支持工具并行执行

- 指数退避 + 分级策略确保重试不会加剧过载

- 输出截断三级恢复把大部分截断错误消化在内部

- 模型降级在高负载时保持服务可用

- 错误分类让每种故障都有可操作的恢复路径

- Prompt 缓存在不改变行为的情况下大幅降低成本

这些机制的共同目标是一句话:宁可慢一点,也不能挂。下一章,我们将面对另一个硬约束:对话越来越长,上下文窗口装不下时,系统如何优雅地"遗忘"。

思考题

-

为什么后台请求在 529 时直接放弃而不是用更温和的方式(比如延迟重试)?提示:思考 N 个客户端同时重试时的总请求量。

-

输出截断恢复的第二级向 LLM 注入"no apology, no recap"消息。如果 LLM 不听这个指令怎么办?系统有没有备用方案?

-

Prompt 缓存的 TTL 为什么要在会话开始时"锁存"?如果允许动态变化,最坏情况下会发生什么?

Chapter 5: 上下文窗口管理:有限记忆下的生存之道

200K token 听起来很多,但对一个不停读文件、跑命令的 Agent 来说,几十分钟就能花光。

┌─────────────── Harness ───────────────┐

│ │

│ Agent Loop ──▶ API ──▶ LLM │

│ │ │

│ ★ 上下文管理 ★ ◀── 本章在这里 │

│ ┌──────────────────────────┐ │

│ │ 1. microcompact (持续) │ │

│ │ 2. snipCompact (持续) │ │

│ │ 3. contextCollapse(按需) │ │

│ │ 4. autoCompact (~93%) │ │

│ │ 5. reactiveCompact(溢出) │ │

│ └──────────────────────────┘ │

│ │

└───────────────────────────────────────┘

本章聚焦:五层压缩防线如何管理有限的上下文窗口

5.1 Agent 为什么比聊天更容易撑爆上下文

问题

普通聊天每轮增加几百 token。为什么 Agent 场景下上下文增长得如此之快?

思路

原因在于工具输出的不对称性。用户说"读一下这个文件"只需几个 token,但文件内容可能有几千行。一次 grep 搜索的输入是一行正则表达式,输出可能是数百个匹配结果。每次工具调用还有结构化的 tool_use block(函数名、参数 JSON)和 tool_result block(完整输出),这些元数据本身也消耗 token。

一个典型的编程会话:读 5-10 个文件、执行几次搜索、编辑多处代码、跑测试——30 轮交互后,上下文轻松超过 100K token。如果启用了 extended thinking,思考过程也计入上下文。

不加管理,200K 的窗口很快就会溢出。更大的窗口(1M)缓解了问题但没有解决——代价是更高的成本和更长的延迟。

上下文管理不是优化,是 Agent 能否长期运行的生死线。

实现

该系统的解决方案是一套多层防御体系。在查询模块的主循环中,每次 API 调用前,消息要过一条预处理管线:

原始消息 -> compactBoundary截断 -> toolResultBudget

-> snipCompact -> microcompact -> contextCollapse -> autoCompact

每一层都在试图"减负",而且它们不互斥——可以叠加作用。从最轻量的"清除旧工具输出"到最重量的"全量摘要替换",按需逐级升级。

这种设计背后的原则是:用最小的代价解决问题,把重炮留给真正需要的时候。

5.2 Microcompact:精准的外科手术

问题

上下文里积累了大量旧的工具输出——三轮前读的文件、五轮前搜索的结果。这些内容对当前任务还有用吗?

思路

大部分情况下没用了。LLM 在三轮前读了一个文件,用那些信息做了决策(比如修改了某个函数),决策结果已经体现在后续的对话中。原始文件内容就成了冗余信息。

Microcompact 的策略是:只清理特定工具的旧输出,保留语义信息。不是所有工具的输出都适合清理——Read、Bash、Grep、Glob、WebSearch、Edit、Write 这些工具产出大块文本内容(文件内容、命令输出、搜索结果),价值随时间衰减。而 AgentTool 等工具的输出包含高级语义信息(子任务的结论),不能随意删除。

实现

可清理的工具被明确枚举在微压缩模块中:

// 可清理工具列表(概念示意)

COMPACTABLE_TOOLS = Set([

FILE_READ, SHELL_TOOLS, GREP, GLOB,

WEB_SEARCH, WEB_FETCH, FILE_EDIT, FILE_WRITE,

])

清理后的内容不是悄悄删除,而是替换为一个标记:

// 清理标记

CLEARED_MESSAGE = '[Old tool result content cleared]'

这个标记让 LLM 知道"这里曾经有内容,但已经被清除了"。如果 LLM 需要这个信息,它会主动重新调用工具获取——比如再读一遍那个文件。这比悄悄删除更安全:LLM 不会基于缺失的信息做错误假设。

Microcompact 还有一套基于时间的触发机制。时间触发评估函数计算距离上一条 assistant 消息过了多久。如果超过阈值(说明用户离开了一会儿),服务端的 Prompt Cache 已经过期,反正要重新计费,不如趁机清理旧内容:

// 时间触发的微压缩(概念示意)

gapMinutes =

(now() - parseTime(lastAssistant.timestamp)) / 60_000

if not isFinite(gapMinutes) or gapMinutes < config.gapThresholdMinutes:

return null

这是一个巧妙的协同:时间触发 + 缓存过期 = 免费的清理机会。

5.3 AutoCompact:当上下文逼近极限

问题

Microcompact 清理了旧工具输出,但新的不断涌入。当上下文逼近窗口极限时怎么办?

思路

这时候需要更激进的策略:把整个对话历史压缩成一段摘要。这就像你写了一天的工作日志,下班前把十页细节浓缩成一段"今日要点"。

AutoCompact 的触发是基于阈值的。以 200K 上下文为例:

- 有效窗口 = 200,000 - 20,000(预留给输出)= 180,000

- 自动压缩阈值 = 180,000 - 13,000 = 167,000(约 93%)

- 阻塞限制 = 180,000 - 3,000 = 177,000(约 98%)

当输入 token 超过 167K 时触发自动压缩。超过 177K 时直接阻止发送请求——留出空间让用户手动 /compact。

实现

阈值计算在自动压缩模块中:

// 自动压缩阈值计算(概念示意)

AUTOCOMPACT_BUFFER_TOKENS = 13_000

MANUAL_COMPACT_BUFFER_TOKENS = 3_000

function getAutoCompactThreshold(model):

effectiveWindow = getEffectiveContextWindowSize(model)

return effectiveWindow - AUTOCOMPACT_BUFFER_TOKENS

这里有一个容易忽略的细节。自动压缩判断函数接受一个 snipTokensFreed 参数:

// 修正 snip 释放的 token

tokenCount = estimateTokenCount(messages) - snipTokensFreed

为什么要手动减去 snip 释放的 token?因为 snipCompact 虽然删除了消息,但幸存的 assistant 消息的 usage 字段仍然反映压缩前的上下文大小(API 报告的 input_tokens 是请求时的值,不会因为后续的本地删除而改变)。不做这个修正,autoCompact 的阈值判断就会失准——明明 snip 已经把上下文压到阈值以下了,但估算值还在上面,导致不必要的全量压缩。

还有一个熔断机制:

// 自动压缩熔断器

MAX_CONSECUTIVE_AUTOCOMPACT_FAILURES = 3

真实数据分析显示:"1,279 个会话有 50+ 次连续失败(最多 3,272 次),每天全球浪费约 25 万次 API 调用"。有些会话的上下文实在太大,摘要本身就超长,压缩注定失败。没有熔断器,系统会在每轮循环都发一次注定失败的压缩请求。三次失败后停止重试,简单粗暴但有效。

5.4 压缩的核心:怎么写一份好摘要

问题

决定压缩之后,怎么确保摘要质量?如果摘要丢失了关键信息,Agent 后续的行为就会出错。

思路

压缩本质上是调另一次 LLM——把完整对话交给它,让它生成一份结构化摘要。这引出几个设计挑战:

- 用什么 prompt?不能太笼统("总结一下"),也不能太啰嗦(prompt 本身占 token)。

- 怎么防止 LLM 在压缩时"自作主张"?比如看到用户之前提过一个未完成的任务,压缩后自己开始做。

- 如果压缩请求本身就因为上下文过长而失败怎么办?(递归问题!)

实现

压缩 prompt 要求 LLM 生成包含 9 个部分的摘要。其中第 6 点特别重要:"List ALL user messages that are not tool results"。这确保了用户的意图在压缩后不会丢失——即使所有工具输出都被浓缩了,用户说过的每一句话都被保留。

第 9 点"Optional Next Step"后面跟着一段警告:

ensure that this step is DIRECTLY in line with the user's most recent explicit requests... Do not start on tangential requests

这是防止一种微妙的故障:LLM 在摘要中写"下一步我应该做 X",压缩后新的 LLM 实例看到这个"下一步"就直接开始做了——但 X 可能是三个任务之前的旧目标,而不是用户当前想要的。

压缩 prompt 前面还有一段强硬的声明:

// 压缩指令前言(概念示意)

NO_TOOLS_PREAMBLE = "CRITICAL: Respond with TEXT ONLY. Do NOT call any tools.

- Tool calls will be REJECTED and will waste your only turn -- you will fail the task.

- Your entire response must be plain text: an <analysis> block followed by a <summary> block."

这是因为压缩使用单轮模式。如果 LLM 尝试调用工具(比如想读一下某个文件来写更好的摘要),这唯一的一次机会就浪费了,压缩直接失败。数据显示在某些模型上,不加这个声明的工具调用率约为 2.79%。

摘要还被格式化处理:后处理函数会剥掉 <analysis> 块。这个块是 LLM 的"草稿纸"——先分析再总结能提高摘要质量,但分析过程本身没有信息价值,留在上下文里只会浪费 token。

5.5 压缩时上下文本身就过长怎么办

问题

压缩需要把完整对话发给 LLM。但如果对话已经超过了上下文窗口,连压缩请求本身都会失败。这是一个鸡生蛋蛋生鸡的问题。

思路

压缩模块中实现了一种递归降级策略:从最老的消息开始丢弃,直到释放够空间。这是有损操作——被丢弃的内容不会出现在摘要里。但总比完全无法压缩好。

实现

算法将消息按 API 轮次分组,然后根据超出量计算需要丢弃多少组:

// 头部截断策略(概念示意)

tokenGap = getPromptTooLongTokenGap(ptlResponse)

if tokenGap is defined:

// 精确计算:从头部丢弃刚好够弥补差距的消息组

acc = 0; dropCount = 0

for group in groups:

acc += roughTokenEstimate(group)

dropCount++

if acc >= tokenGap: break

else:

// 模糊估计:丢弃 20% 的消息组

dropCount = max(1, floor(groups.length * 0.2))

两条路径:如果 API 错误消息里包含了精确的 token 超出量("137500 tokens > 135000 maximum"),就精确计算要丢弃多少;否则粗暴地丢 20%。最多重试 3 次。

注意一个边界条件:丢弃最老的消息组可能导致序列以 assistant 消息开头,违反 API 的"第一条消息必须是 user"规则。代码在这种情况下会插入一条合成的 user 标记消息。

5.6 压缩后的世界重建

问题

压缩把所有历史替换成一段摘要。LLM 失去了对之前读过的文件的直接访问。怎么补救?

思路

完全靠摘要是不够的。摘要能记住"我修改了 config.ts 的第 42 行",但不能记住 config.ts 的完整内容。如果 LLM 接下来需要继续编辑那个文件,它得重新读一遍。

系统设计者的策略是:主动重建最近访问的文件上下文。压缩完成后,系统会重新读取最近访问的文件,作为附件注入到压缩后的上下文中。

实现

重建的参数:

// 压缩后文件重建参数(概念示意)

MAX_FILES_TO_RESTORE = 5

TOKEN_BUDGET = 50_000

MAX_TOKENS_PER_FILE = 5_000

最多恢复 5 个文件,每个文件最多 5K token,总预算 50K token。文件按最近访问时间排序,越新越优先。这些参数是权衡的结果:恢复太多文件浪费 token,恢复太少 LLM 需要额外的工具调用来重新获取上下文。

压缩前还会剥离图片和 PDF,替换为 [image] 和 [document] 标记。原因是双重的:图片不需要摘要(它们的语义已经在对话文本中被讨论过),而且图片可能导致压缩请求本身超过上下文限制。

压缩后的消息序列有严格的顺序:

// 压缩后消息构建(概念示意)

function buildPostCompactMessages(result):

return [

result.boundaryMarker, // 分界线

...result.summaryMessages, // 摘要

...(result.messagesToKeep), // 需要保留的原始消息

...result.attachments, // 文件重建

...result.hookResults, // Hook 结果

]

boundaryMarker 是一个特殊的系统消息,标记压缩发生的位置。它的作用至关重要:边界查找函数确保 API 只看到最近一次压缩之后的消息。压缩前可能有数百条消息,压缩后被替换为这几条精心组织的消息。

5.7 ReactiveCompact:亡羊补牢

问题

如果所有主动策略都未能阻止上下文溢出,API 返回了"Prompt is too long"错误。这时候怎么办?

思路

ReactiveCompact 是最后一道防线。它的触发条件不是"上下文快满了",而是"已经溢出了"——API 实际报错之后才启动。

设计的关键在于错误扣留:prompt-too-long 错误在流式循环中被"扣留"(withheld),不立即暴露给调用者。这给了恢复机制一个窗口期来尝试修复。

实现

扣留逻辑在流式循环中。多种可恢复错误(prompt-too-long、media-size-error、max-output-tokens)都用同一个扣留标志控制:

// 错误扣留机制(概念示意)

withheld = false

if reactiveCompact.isWithheldPromptTooLong(message): withheld = true

if isWithheldMaxOutputTokens(message): withheld = true

if not withheld: yield yieldMessage

流式循环结束后,检查是否有被扣留的错误,并尝试反应式压缩:

// 反应式压缩尝试(概念示意)

if (isWithheld413 or isWithheldMedia) and reactiveCompact:

compacted = await reactiveCompact.tryReactiveCompact({

hasAttempted: hasAttemptedReactiveCompact,

messages: messagesForQuery,

// ...

})

if compacted:

nextState = {

messages: buildPostCompactMessages(compacted),

hasAttemptedReactiveCompact: true, // 只尝试一次

transition: { reason: 'reactive_compact_retry' },

}

state = nextState

continue // 用压缩后的上下文重试

hasAttemptedReactiveCompact: true 保证只尝试一次。如果压缩后仍然超长,说明问题不在历史长度(可能是单条消息就超过了窗口),继续重试没有意义,错误最终暴露给用户。

注意恢复失败时的处理:

// 恢复失败:释放扣留的错误

yield lastMessage // 释放之前扣留的错误

executeStopFailureHooks(lastMessage, toolUseContext)

return { reason: 'prompt_too_long' }

Stop Hooks 在这里被显式跳过。原因是:模型根本没有产出有效回复,Stop Hooks 没有什么可以评估的。如果让 Stop Hooks 运行,它们会注入额外的消息让循环继续——但上下文已经溢出了,继续只会制造死循环。

5.8 预算不可洗白

问题

压缩会抹去历史消息,token 计数重新变小。这是否意味着通过反复压缩可以"免费"使用无限量的 token?

思路

不可以。查询模块中维护了一个跨压缩边界的 Token 预算追踪:

// 跨压缩边界的预算追踪

taskBudgetRemaining: Number or undefined = undefined

每次压缩时,记录压缩前的上下文大小,并从剩余预算中扣除。即使消息被替换为摘要,已经消耗的预算不会被"洗白"。

实现

预算扣除逻辑:

// 压缩后的预算扣除(概念示意)

if params.taskBudget:

preCompactContext = finalContextTokensFromLastResponse(messages)

taskBudgetRemaining = max(

0,

(taskBudgetRemaining ?? params.taskBudget.total) - preCompactContext,

)

读取的是 API 返回的实际 input_tokens,不是估算值。这确保了预算追踪的精度。

关键解释:"压缩前,服务端能看到完整历史,自己计算消耗;压缩后,服务端只看到摘要,无法知道之前花了多少,所以客户端必须通过 remaining 字段告诉它"。

5.9 五层防御全景

把所有机制放在一起,按 token 使用量从低到高排列:

Token 使用量 -->

|-- 正常 --|-- microcompact --|-- autoCompact --|-- 阻塞 --|-- 溢出 --|

0 ~60% ~93% ~98% ~100%

层级:

1. microcompact (持续) 清除旧工具输出的大块内容

2. snipCompact (持续) 裁剪最老的消息轮次

3. contextCollapse (按需) 折叠旧交互,保留细节可恢复

4. autoCompact (~93%) 全量摘要,重建文件附件

5. reactiveCompact (溢出后) API 报错后的紧急压缩

每一层都有其适用场景:

- Microcompact 在每次 API 调用前静默运行,不需要额外的 API 调用,成本为零

- SnipCompact 比 microcompact 更激进,直接删除最老的消息轮次

- ContextCollapse 折叠旧交互但保留可恢复性——需要时可以展开

- AutoCompact 是"核选项",需要一次额外的 API 调用来生成摘要

- ReactiveCompact 是最后防线,只在 API 实际报错后才触发

层级化设计的好处:90% 的情况下,microcompact + snip 就够了,根本不需要动用昂贵的全量压缩。

5.10 小结

上下文窗口管理的本质是信息取舍:什么该记住,什么可以忘记。该系统的答案有四个要点:

-

渐进式遗忘。先忘细节(工具输出),再忘过程(交互轮次),最后忘全部(压缩为摘要)。每一步都是最小必要的信息损失。

-

选择性记忆。压缩后不是从零开始——重建最近访问的文件、保留活跃的计划、重新注入技能说明。

-

兜底机制。即使所有预防措施都失败,还有 reactive compact 在 API 报错后紧急救场。失败了就再试一次,再失败才放弃。

-

预算不可洗白。压缩可以缩短历史,但累计的 Token 消耗不会被重置。这防止了通过反复压缩来规避预算限制。

这套系统让该 Agent 能在理论上有限的"记忆"中,维持长达数小时的复杂编程会话。不是魔法,是层层叠叠的工程防御。

思考题

-

Microcompact 为什么不清理 AgentTool 的输出?子 Agent 的结论和 Read 工具读的文件内容有什么本质区别?

-

AutoCompact 的熔断器设为 3 次。如果设为 1 次会怎样?如果设为 10 次呢?思考两种极端情况下的权衡。

-

压缩后重建文件上下文时,最多恢复 5 个文件、每个 5K token。如果用户的工作涉及 20 个文件怎么办?系统有没有其他途径让 LLM 获取缺失的文件内容?

Part III: 工具系统 -- Agent 的手和脚

没有工具的 LLM 只能说话。有了工具,它才能做事。

这个 Part 要解决什么问题

LLM 唯一能做的事情是输出文本。工具系统的使命,是把文本输出变成真实世界的操作——读文件、执行命令、搜索代码、访问网页。

但这不是「给每个功能写个函数」那么简单。当你有 40 多个功能各异的工具,你需要回答一连串架构问题:如何定义统一的接口让工具之间互操作?如何注册和发现工具,让 LLM 知道自己有哪些能力?当系统启动时就加载全部 40 个工具的 Schema,对 token 预算的冲击有多大?多个工具同时被调用时怎么并行?工具输出几千行文本怎么控制预算?

Part III 从接口设计讲到注册调度,从每类工具的设计取舍讲到并发编排,完整覆盖工具系统的三个层面:工具长什么样(定义)、工具怎么被找到(注册与调度)、工具怎么一起工作(编排)。

包含章节

Chapter 6: 工具的设计哲学 -- 接口、注册与调度。 Tool 接口为什么用结构类型而不用类继承?三个泛型参数(Input、Output、Progress)分别约束什么?延迟加载的 Deferred Schema 模式如何将 token 成本从「启动时全部支付」变为「按需支付」?这一章是理解整个工具系统的关键转折点。

Chapter 7: 40 个工具巡礼 -- 从文件读写到浏览器。 文件操作工具为什么要限制单次读取的行数?Bash 工具如何在给予操作系统级能力的同时保持可控?搜索工具的 Glob 和 Grep 为什么要分开而不合并?Web 工具、Agent 工具、MCP 工具各自的设计取舍是什么?

Chapter 8: 工具编排 -- 并发、流式进度与结果预算。 当 LLM 一次返回多个 tool_use 块时,哪些工具可以并行、哪些必须串行?流式进度(ToolCallProgress)如何让用户在工具执行期间不会面对黑屏?工具输出太大时,结果预算(result budget)和结果裁剪策略如何在保留关键信息的前提下控制 token 开销?

与其他 Part 的关系

- 前置知识:Part I 的心智模型(工具系统在 Harness 中的角色),Part II 的 Agent Loop(工具执行发生在循环内部)。Chapter 6 可以在只读完 Chapter 1 的情况下独立阅读。

- 后续延伸:工具的权限检查机制在 Part IV 中深入展开。子 Agent 工具(AgentTool)和团队工具(TeamCreate、SendMessage)是 Part V 多智能体的入口。MCP 工具(Chapter 7 中提及)在 Part VII Chapter 18 中详细拆解。Skill 工具在 Part VII Chapter 19 中展开。

Chapter 6: 工具的设计哲学 -- 接口、注册与调度

LLM 本身不能读文件、不能执行命令、不能访问网络。它唯一能做的事情是输出文本。工具系统的使命,是把文本输出变成真实世界的操作。理解工具系统的设计,是理解整个 Agent 架构的关键转折点。

┌─────────────── Harness ───────────────┐

│ │

│ Agent Loop ──▶ API ──▶ LLM │

│ │ │

│ ▼ │

│ ★ 工具系统 ★ ◀── 本章在这里 │

│ ┌──────────────────────────┐ │

│ │ Tool<I,O,P> 接口定义 │ │

│ │ buildTool() 安全默认值 │ │

│ │ 注册 ──▶ 过滤 ──▶ 调度 │ │

│ │ Deferred Tools 按需加载 │ │

│ └──────────────────────────┘ │

│ │

└───────────────────────────────────────┘

本章聚焦:工具的接口设计、注册机制与调度流程

6.1 一个工具应该长什么样?

问题:如何为 40 多个功能各异的工具定义一个统一的接口?

这个问题的答案将直接影响系统的扩展性。接口太松散,工具之间无法互操作;接口太严格,新工具的开发成本过高。我们来看该系统是怎么在这两端之间找到平衡的。

想象你在设计一个插件系统。最朴素的做法是定义一个基类,让每个工具继承它。但继承意味着层级、意味着耦合、意味着一个基类变更牵动所有子类。系统设计者选择了另一条路:用 TypeScript 的类型系统替代继承层次。

在工具定义模块中,核心定义是:

// 工具类型定义(概念示意)

type Tool<Input, Output, ProgressData> = { ... }

注意,这是一个类型,不是一个类。工具在这个系统中是"满足特定结构的对象",不是"某个类的实例"。三个泛型参数为每个工具提供精确的类型约束:BashTool 的输入包含 command 字段,FileReadTool 的输入包含 file_path 字段 -- 类型系统在编译期就能捕获接口不匹配。

这种选择背后有一个工程理由:当你有 40+ 个工具,且每个工具的输入输出结构完全不同时,类继承几乎无法提供有意义的复用。一个统一的结构类型(structural type)反而更灵活 -- 任何满足接口契约的对象都是合法的工具,不需要知道彼此的存在。

如果你熟悉 Go 语言的接口设计,这里有一个类似的哲学:Go 的接口是隐式满足的(duck typing),不需要显式声明 implements。TypeScript 的结构类型系统提供了同样的灵活性,但比 Go 更强 -- 它有泛型,可以在编译时约束输入和输出的精确类型。

顺便说一句,Tool 类型有三个泛型参数,但实际上 Output 在运行时几乎不参与类型检查 -- 它主要用于结果转换的类型推断。真正起约束作用的是 Input(Schema 驱动的验证)和 ProgressData(进度事件类型,确保 BashTool 发射 Bash 进度而不是 Agent 进度)。

思路:Tool 接口的每个字段都在回答一个具体的问题。

让我们逐一拆解。

6.1.1 identity -- 你是谁?

name 是工具的主标识符,也是 LLM 在输出 tool_use block 时引用的名称。aliases 处理重命名的向后兼容 -- 当工具改名时,旧名称作为别名保留,让历史对话中的调用仍然能路由到正确的工具。

searchHint 是一段 3-10 个词的短语。它存在的原因并不直观:当工具被延迟加载时(6.7 节详述),模型只能看到工具名称。但 NotebookEditTool 的名字里没有"jupyter"这个词,用户却会说"编辑我的 jupyter notebook"。searchHint 弥补了工具名和用户意图之间的语义鸿沟。设计要求"prefer terms not already in the tool name" -- 重复工具名中已有的词是浪费 searchHint 的宝贵空间。

6.1.2 execution -- 你怎么干活?

工具接口中与执行相关的方法有三个,各自扮演不同角色。

call() 是工具的心脏。它的签名揭示了一个重要的设计决策:

// 工具执行方法签名(概念示意)

call(

args: ValidatedInput, // 经过 Schema 验证后的输入

context: ToolUseContext, // 执行上下文

canUseTool: PermCheckFunction, // 权限检查回调

parentMessage: AssistantMessage, // 触发此调用的消息

onProgress?: ProgressCallback, // 进度回调

) -> ToolResult

注意输入的类型是经过 Schema 验证后的数据 -- 传入执行方法的数据已经经过验证。这意味着工具实现者不需要再做输入校验,减少了一类重复的防御性代码。

description() 是动态的,可以根据输入参数变化。BashTool 就利用了这一点:如果模型提供了 description 参数(比如"Install package dependencies"),直接使用它;否则返回通用描述 "Run shell command"。这让 UI 对话框能展示有意义的操作描述,而不是千篇一律的工具名。

还有两个值得注意的执行相关方法。validateInput() 在 call() 之前运行,做纯粹的参数合法性检查 -- 路径存在吗?范围有效吗?设备路径安全吗?它不涉及用户交互,失败后直接返回错误消息给模型。而 checkPermissions() 做权限决策,可能触发 UI 对话框等待用户确认。分离这两步让验证失败快速反馈(毫秒级),权限拒绝走完整的交互流程(可能等待几秒的用户响应)。

6.1.3 safety -- 你有多危险?

这是接口设计中最体现"哲学"的部分。三个布尔方法构成了工具的安全分类体系:

isConcurrencySafe(input):能否与其他工具并行执行?isReadOnly(input):这次调用是否只读?isDestructive(input):是否不可逆?

关键细节:这三个方法都接受 input 参数。安全性不是工具的静态属性,而是每次调用的动态判断。同一个 BashTool,执行 ls 时是并发安全的,执行 rm -rf 时不是。FileReadTool 总是只读的,但 BashTool 需要解析命令 AST 才能判断。这种"按调用判断"的设计精度,远高于"按工具分类"的粗粒度方案。

另一个容易被忽略的安全方法是 interruptBehavior()。当用户在工具执行中输入新消息时,这个方法决定工具的行为:'cancel' 意味着停止并丢弃结果(适合搜索、读取等幂等操作),'block' 意味着继续执行直到完成(适合正在写文件或运行构建的操作)。默认是 'block' -- 再次体现安全关闭原则:不确定时,不中断。

6.1.4 budget -- 你的输出有多大?

maxResultSizeChars 控制工具结果的持久化阈值。当输出超过此大小时,系统将完整结果写入磁盘文件,只给模型发送一个 2KB 的预览。

这个字段的取值选择很有讲究。BashTool 设为 30,000 字符,AgentTool 设为 100,000 字符。而 FileReadTool 设为 Infinity -- 因为 Read 工具自己有 token 限制,如果它的结果被持久化到文件再让模型用 Read 去读,就形成了"Read -> 文件 -> Read"的循环。Infinity 是一种"我自己负责控制大小"的声明。

6.1.5 presentation -- 用户看到什么?

Tool 类型中有六个渲染方法,控制工具在 UI 中的每一帧呈现:执行中显示什么、结果显示什么、进度显示什么、被拒绝时显示什么、出错时显示什么、多个同类工具并行时怎么分组显示。

这些方法全部是可选的 -- 省略任何一个,系统回退到默认呈现。这让简单工具只需定义执行方法和几个必要方法,而复杂工具可以完全控制用户看到的每一帧。这种"渐进式定制"降低了工具开发的入门门槛,同时不限制高级用例的表达力。

6.2 ToolUseContext -- 工具执行时的世界模型

问题:一个工具在执行时需要知道多少关于外部世界的信息?

答案是:相当多。工具执行上下文是传递给每个执行方法的上下文对象,它描述了工具执行时的完整环境。这个类型有 40 多个字段,初看令人畏惧,但每一组字段都在解决一个具体的问题。

生命周期控制。 abortController 让每个工具执行都绑定到一个取消信号。用户按 Escape、兄弟工具出错、系统超时 -- 都通过这一个通道通知工具停止。这比让每个工具各自实现超时逻辑优雅得多。AbortController 是浏览器 API 的标准模式,但在这里它被嵌套使用(第 8 章将详述三层嵌套的取消体系),形成了精确的取消粒度控制。

状态共享。 readFileState 是一个 LRU 缓存,存储最近读过的文件内容和修改时间。FileReadTool 用它做去重 -- 如果文件没变且读取范围相同,返回一个存根而不是重新发送全部内容。FileEditTool 编辑文件后也更新这个缓存的 mtime,确保后续 Read 不会错误地认为"文件没变"。

身份标识。 agentId 和 agentType 标识了工具所在的 agent。当工具在子 agent 中执行时,权限检查和状态管理需要知道"这是谁在调用"。

预算跟踪。 contentReplacementState 是工具结果预算系统的核心状态,记录了哪些工具结果已经被替换为预览、哪些被保留为原文。这个状态跨 turn 持久化,确保替换决策的一致性以保护 prompt cache(第 8 章详述)。

交互能力。 工具可以向终端 UI 注入自定义的 React 组件 -- 比如 BashTool 在权限对话框中展示 sed 命令的 diff 预览。工具还可以请求用户的交互式输入,但只在 REPL(交互式)上下文中可用,SDK 模式下不可用。

全局状态桥接。 上下文提供对全局应用状态的读写。但对于子 Agent,写入状态是一个 no-op(防止子 Agent 意外修改主线程状态)。如果子 Agent 需要注册后台任务这种跨生命周期的操作,必须使用专门的任务状态写入通道 -- 它直接到达根状态存储。

为什么要传这么多东西?因为一个工具调用的语义,远不止"输入 -> 输出"那么简单。它需要知道自己能不能被取消、之前读过什么文件、自己属于哪个 agent、上下文预算还剩多少。工具执行上下文是一种"依赖注入"的实践 -- 把工具从全局状态中解耦,通过显式参数传递它需要的一切。

6.3 ToolResult -- 工具能做什么?

问题:工具返回结果时,除了"数据"以外还能做什么?

// 工具结果类型(概念示意)

ToolResult<T> = {

data: T

newMessages?: List<Message> // 注入额外消息

contextModifier?: Function // 修改执行上下文

mcpMeta?: { meta, structured } // MCP 协议元数据

}

四个字段,四种能力(mcpMeta 是 MCP 协议的元数据透传,用于 SDK 消费者)。我们聚焦前三个:

返回数据(data)是主输出,经过转换函数后发给模型。

注入消息(newMessages)让工具在对话中插入额外内容。FileReadTool 读取图片时,会注入一个包含 base64 图片数据的 user message(标记为元消息,表示这不是用户输入而是系统注入的补充信息);读取 PDF 时,注入 document block。这些注入的消息在用户对话之外,为模型提供了多模态感知能力。图片还可能附带一条元数据文本消息,包含原始尺寸和缩放后尺寸,帮助模型理解坐标映射关系。

修改上下文(contextModifier)让工具改变后续工具看到的环境。但这里有一条关键约束:上下文修改仅对非并发安全工具生效。原因很简单:并发工具的执行顺序不确定,如果它们都修改上下文,结果将不可预测。

这三个能力的层次递进 -- 返回数据 < 注入消息 < 修改上下文 -- 构成了工具影响力的光谱。大多数工具只用 data,少数多模态工具用 newMessages,极少数需要修改全局状态的工具才用 contextModifier。

结果到 API 的转换由专门的映射方法完成。这个方法的存在揭示了一个重要的关注点分离:工具内部用自己的强类型数据结构(BashTool 用 { stdout, stderr, interrupted },FileReadTool 用判别联合),而 API 层需要 SDK 定义的标准格式。两层之间的转换是显式的,每个工具自己负责 -- 这意味着 BashTool 可以决定把 stdout 中的图像数据编码为 image block,而 FileReadTool 可以决定给文本内容附加安全提醒。转换逻辑和执行逻辑分离,让它们可以独立演进。

6.4 buildTool() -- 安全的默认值

问题:Tool 接口有 30+ 个字段,定义一个新工具是否需要全部填写?

不需要。工具构建工厂函数提供了一组经过深思熟虑的默认值:

// 工具默认属性(概念示意)

TOOL_DEFAULTS = {

isEnabled: () -> true,

isConcurrencySafe: (input?) -> false,

isReadOnly: (input?) -> false,

isDestructive: (input?) -> false,

checkPermissions: (input, ctx?) ->

resolve({ behavior: 'allow', updatedInput: input }),

}

注意默认值的倾向性:并发不安全、非只读、非破坏性。当开发者忘记设置这些属性时,系统倾向于更保守的行为 -- 不会并行执行、不会标记为可安全跳过权限。这就是"安全关闭"(fail-closed)原则:未知情况下,选择限制而非放行。

工厂函数的类型体操确保返回值满足完整的 Tool 类型,同时保留每个工具定义的精确类型推断。这意味着你在编辑器中对 BashTool 做调用时,能看到 BashTool 专属的参数类型提示 -- 泛型信息没有在工厂包装中丢失。

理解工厂函数的价值,可以想想没有它会怎样。每个工具定义都要手写样板代码。忘了写一个?类型检查报错,但错误信息指向一个 30 字段的接口,很难定位遗漏了哪个。有了工厂函数,遗漏的字段自动获得安全默认值,开发者只需要关注与自己工具相关的字段。

工具定义辅助类型进一步简化了工具定义。它用类型操作的组合,把 defaultable 方法标记为可选:

// 工具定义辅助类型(概念示意)

ToolDef<Input, Output, P> =

RequiredFields(Tool<Input, Output, P>)

+ OptionalFields(DefaultableKeys)

这意味着工具定义可以做类型检查(确保提供了所有必要字段),而不需要手动填充所有可默认字段。工厂函数在运行时完成填充,类型系统在编译时确保结果满足完整的 Tool 接口。编译时安全 + 运行时便利,两手都抓。

值得注意的是,默认的 checkPermissions 实现是直接放行。这看似与"安全关闭"矛盾,但实际上权限检查有两层:工具自身的权限检查和通用权限系统。通用系统总是运行的,工具的权限检查是额外的、工具特定的检查。默认放行意味着"我没有额外的权限需求,交给通用系统判断"。

6.5 工具集合的类型约束

在深入注册机制之前,有一个小但重要的类型细节值得注意。工具集合被定义为:

// 工具集合类型(概念示意)

type Tools = readonly List<Tool>

这不是简单的可变数组,而是只读数组。readonly 修饰符防止了工具数组在传递过程中被意外修改 -- 添加、删除、替换元素都会导致编译错误。这在一个工具数组被 10+ 个模块引用的系统中至关重要:如果某个过滤函数意外地追加了一个元素,它会污染所有持有同一引用的模块。

这个类型存在的另一个理由是:"make it easier to track where tool sets are assembled, passed, and filtered across the codebase"。在编辑器中搜索这个类型的使用处,比搜索泛型数组更精确。一个命名类型,就是一个可追踪的契约。

6.6 注册与过滤 -- 三层门卫

问题:工具怎么从"定义"变成"可用"?

工具注册在工具集合模块中完成。与许多插件系统不同,这里没有运行时注册 API -- 所有工具以数组形式硬编码。

这种静态注册方式看似原始,实则有几个好处:完整的类型检查、可预测的工具顺序(影响 prompt cache 稳定性)、以及构建时的死代码消除。看条件加载模式:

// 条件工具加载(概念示意)

REPLTool = ENV.USER_TYPE == 'ant'

? require('tools/REPLTool') : null

当条件不满足时,整个模块不会被加载,打包工具可以将其从最终产物中移除。这种"编译时门控"比运行时 if-else 更高效。

类似的模式遍布整个注册列表。特性门控控制实验性功能,用户类型门控控制内部工具,版本门控控制不同的工具变体。每个门控都是一个二元决策:存在或不存在,没有"半启用"的中间状态。这种全有或全无的粒度,在打包和分发时提供了最大的优化空间。

从注册到最终的工具池,经过三层过滤:

第一层:权限过滤。 移除被 deny 规则完全禁止的工具。如果用户在配置中添加了 Bash: deny,BashTool 连模型都看不到。

第二层:模式过滤。 当 REPL 模式启用时,底层原始工具(Bash、Read 等)被隐藏,只暴露 REPLTool。这是一种"界面收窄" -- REPL 内部仍然可以使用那些工具,但模型的直接调用路径被关闭了。

第三层:启用状态过滤。 每个工具的 isEnabled() 做运行时检查。工具可以根据当前环境(操作系统、feature flag、已连接的服务)决定自己是否可用。比如 PowerShellTool 只在 Windows 上启用,WebBrowserTool 只在对应 feature flag 开启时可用。

这三层过滤的顺序是有意义的:权限过滤最先(最便宜的检查),模式过滤次之(影响工具集的结构),启用状态最后(可能涉及运行时检查)。这种"成本递增"的过滤顺序,确保了大部分工具在最早的阶段就被筛除,减少后续阶段的计算量。